神经科学和人工智能领域的多位著名学者近日发表 NeuroAI 白皮书认为,神经科学长期以来一直是推动人工智能(AI)发展的重要驱动力,NeuroAI 领域的基础研究将推动下一代人工智能的进程。文章发表后引发热议:神经科学是否推动了人工智能?未来的人工智能是否需要神经科学?

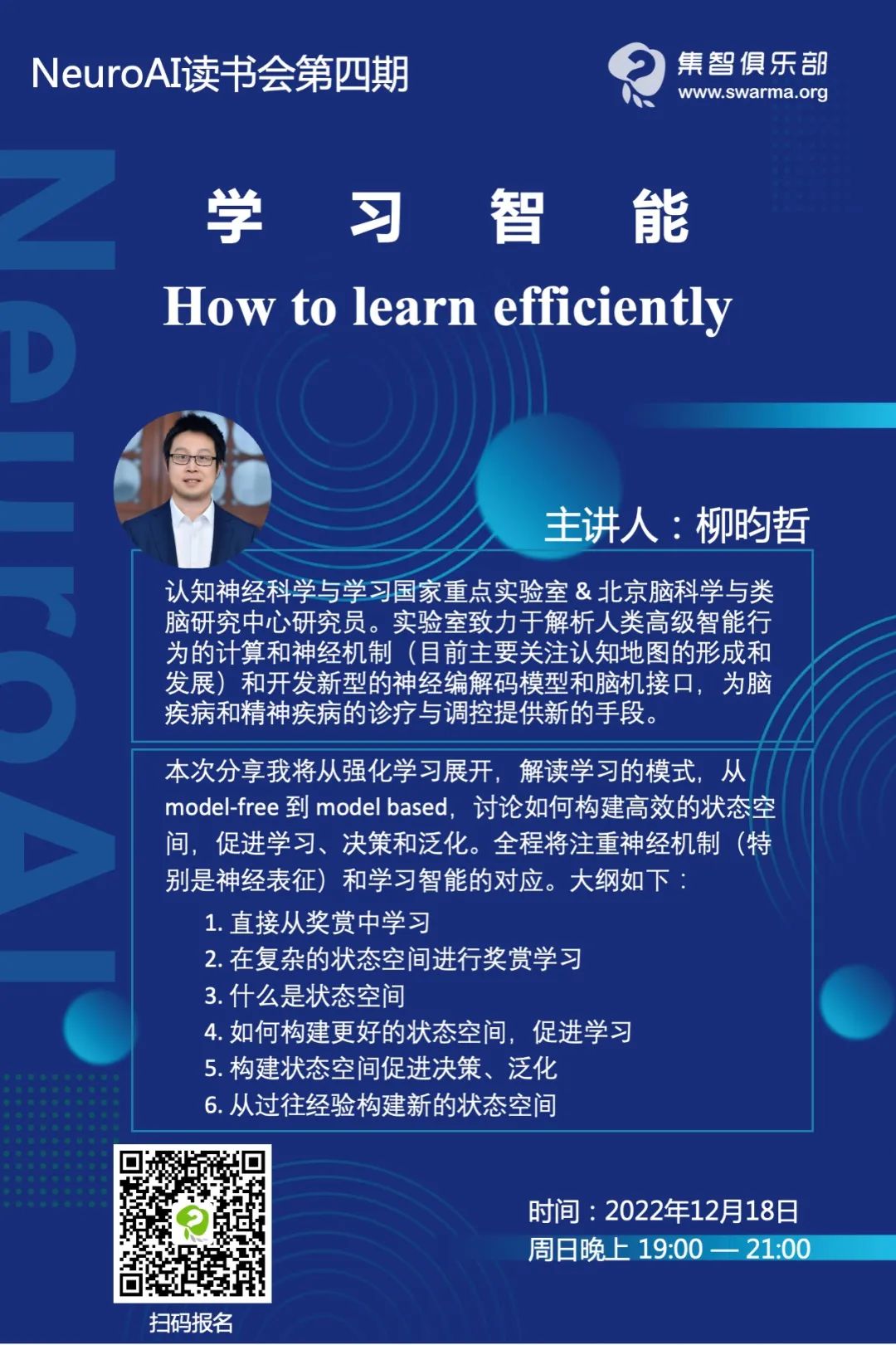

本着促进神经科学、计算机科学、认知科学和脑科学等不同领域的学术工作者的交流与合作,集智俱乐部联合北京师范大学柳昀哲、北京大学鲍平磊和昌平实验室吕柄江三位研究员共同发起了「NeuroAI」读书会,聚焦在视觉、语言和学习领域中神经科学与人工智能的相关研究,期待能够架起神经科学与人工智能领域的合作桥梁,激发跨学科的学术火花。

读书会线上进行,11月27日开始,每周日下午14:00-16:00,持续时间预计10周。读书会详情及参与方式见后文。

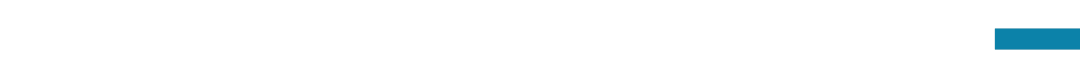

什么是学习,从强化学习的角度,即构建状态空间(state space),并基于状态空间做出一系列选择,目的是趋利避害。这也是生物智能最核心的功能,本次分享我将从强化学习展开,解读学习的模式,从model-free 到 model based,讨论如何构建高效的状态空间,促进学习、决策和泛化。全程将注重神经机制(特别是神经表征)和学习智能的对应。

-

直接从奖赏中学习

-

在复杂的状态空间进行奖赏学习

-

什么是状态空间

-

如何构建更好的状态空间,促进学习

-

构建状态空间促进决策、泛化

-

位置细胞、网格细胞(Place cell、Grid cell)

预测性表征(Predictive representation)

强化学习(Reinforcement learning)

-

柳昀哲老师发布了认知地图词条任务待领取:https://pattern.swarma.org/bounty_mission/465

柳昀哲,2016 年于北京师范大学获得硕士学位,2020年于伦敦大学学院获得博士学位,2020年-2021年在牛津大学从事博士后 研究。2021年至今任认知神经科学与学习国家重点实验室 & 北京脑科学与类脑研究中心研究员。

柳昀哲实验室致力于解析人类高级智能行为的计算和神经机制(目前主要关注认知地图的形成和发展)和开发新型的神经编解码模型和脑机接口,为脑疾病和精神疾病的诊疗与调控提供新的手段。

这两篇文献是柳老师推荐的关于认知地图的两篇文献,什么是认知地图以及如何构建认知地图。提前阅读学习能够帮助大家更好的理解本次分享的内容。

[1] Behrens, Timothy EJ, et al. “What is a cognitive map? Organizing knowledge for flexible behavior.” Neuron 100.2 (2018): 490-509.

[2] Whittington, James CR, et al. “How to build a cognitive map.” Nature Neuroscience (2022): 1-16.

这篇文献是第一篇deepRL,展现了结合深度学习网络的表征能力和强化学习算法的灵活学习能力后的潜力,其中experience replay的运用在分离当前经验对学习的作用上非常关键。

[3] Mnih, V., Kavukcuoglu, K., Silver, D., Rusu, A. A., Veness, J., Bellemare, M. G., … & Hassabis, D. (2015). Human-level control through deep reinforcement learning. Nature, 518(7540), 529-533.

这篇文献基于强化学习理论,给出了neural replay的计算模型,normative model,这个model可以解释很多老鼠身上replay的现象。

[4] Mattar, M. G., & Daw, N. D. (2018). Prioritized memory access explains planning and hippocampal replay. Nature neuroscience, 21(11), 1609-1617.

这篇文献同时从算法和神经层面提出了表征式强化学习的机制,简单而言,即不同 neuron 编码不同的value,所有neuron一起编码了value的分布 – 这种表征可以极大地提高人工智能体的performance,也是生物体多巴胺神经元的表征机制。

[5] Lowet, Adam S., et al. “Distributional reinforcement learning in the brain.” Trends in Neurosciences 43.12 (2020): 980-997.

这篇文献通过区别 slow learning 和 fast learning, 提出meta learning system 可以作为前额叶的计算机理的研究框架 – 对解决 learning to learn 等泛化问题,提供了新的解决思路。

[6] Wang, J. X., Kurth-Nelson, Z., Kumaran, D., Tirumala, D., Soyer, H., Leibo, J. Z., … & Botvinick, M. (2018). Prefrontal cortex as a meta-reinforcement learning system. Nature neuroscience, 21(6), 860-868.

这篇文献是发表在Cell上的一篇关于机器学习模型揭示大脑怎样整合空间记忆与关系记忆的文章(点击查看解读文章)。

[7] Whittington, J. C., Muller, T. H., Mark, S., Chen, G., Barry, C., Burgess, N., & Behrens, T. E. (2020). The Tolman-Eichenbaum machine: unifying space and relational memory through generalization in the hippocampal formation. Cell, 183(5), 1249-1263.

这篇文献基于海马-内嗅皮层的架构和学习机理,提出了学习和泛化的计算模型,将目前预训练语言模型Transformer架构的表征方式与人类海马体的表征方式在数学上进行关联比较,为解释Transformer的biological plausibility提供崭新视角。

[8] Whittington, J. C., Warren, J., & Behrens, T. E. (2021). Relating transformers to models and neural representations of the hippocampal formation. International Conference on Learning Representations (ICLR).

这篇文献提出一种类似于HMM的海马计算模型,相对于TEM,其好处是更快的学习;坏处是难以分析结构泛化的机制和神经表征。

[9] George, D., Rikhye, R. V., Gothoskar, N., Guntupalli, J. S., Dedieu, A., & Lázaro-Gredilla, M. (2021). Clone-structured graph representations enable flexible learning and vicarious evaluation of cognitive maps. Nature communications, 12(1), 1-17.

本次分享是总领性的介绍,期望和大家就学习的问题铺开下去讨论、研究,特别是什么是有效的状态空间,如何构建有效的状态空间。

时间:

2022年12月18日(本周日)晚上19:00-21:00

扫码参与NeuroAI读书会,加入群聊,获取系列读书会回看权限,成为NeuroAI社区的种子用户,与社区的一线科研工作者与企业实践者沟通交流,共同推动NeuroAI社区的发展。

神经科学和人工智能领域的多位著名学者近日发表 NeuroAI 白皮书认为,神经科学长期以来一直是推动人工智能(AI)发展的重要驱动力,NeuroAI 领域的基础研究将推动下一代人工智能的进程。文章发表后引发热议:神经科学是否推动了人工智能?未来的人工智能是否需要神经科学?

本着促进神经科学、计算机科学、认知科学和脑科学等不同领域的学术工作者的交流与合作,集智俱乐部联合北京师范大学柳昀哲、北京大学鲍平磊和昌平实验室吕柄江三位研究员共同发起了「NeuroAI」读书会,聚焦在视觉、语言和学习领域中神经科学与人工智能的相关研究,期待能够架起神经科学与人工智能领域的合作桥梁,激发跨学科的学术火花。

点击“阅读原文”,报名读书会