关键词:神经形态计算,储层计算,循环神经网络

论文题目:Emerging opportunities and challenges for the future of reservoir computing

论文期刊:Nature Communications

论文链接:https://www.nature.com/articles/s41467-024-45187-1

虽然深度学习方法在许多领域取得了显著突破,但这些方法往往依赖于庞大且复杂的神经网络模型进行训练,在实际应用中带来了不小挑战。因此,急需寻找小巧、轻量级并能快速推理及适应新环境的模型。作为一种可能替换当前深度学习范式的趋势, 神经形态计算引起广泛关注。其目标是开发出功耗远低于基于晶体管电路设计原则下现存计算机系统,并摒弃传统冯·诺依曼架构,从生物及物理原理获取灵感。

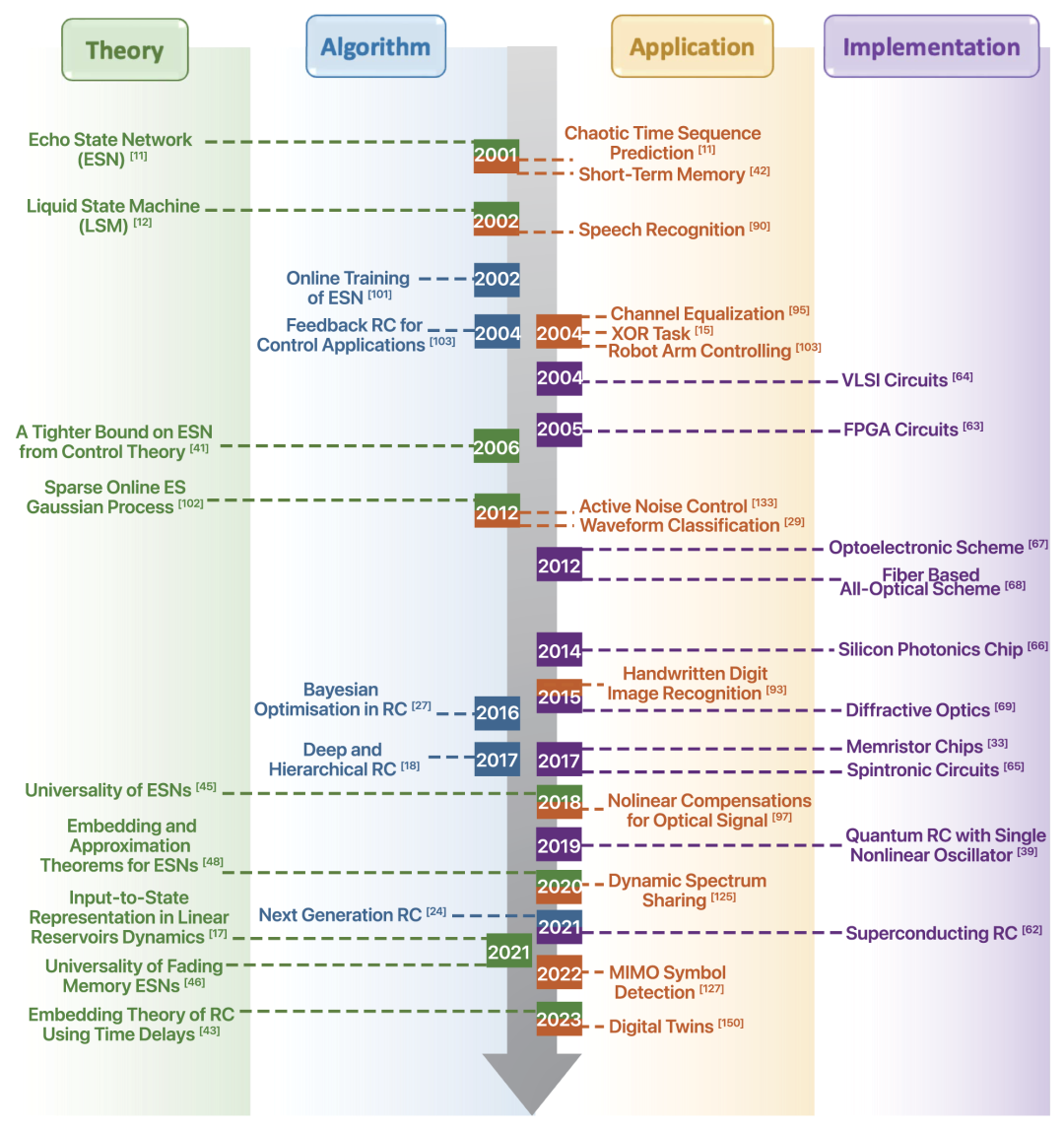

最近发表于Nature Communications的一项研究,梳理储层计算(Reservoir Computing, RC)的研究进展。储层计算作为神经形态计算的一个重要分支,在过去二十年中取得明显进展。这类模型利用固定且随机生成的较小循环神经网络——也就是“储层”,通过其与输入信号的交互产生丰富的动态响应,只需训练输出层来读取这些响应。这种设计大幅减少了参数空间和计算负担,使得储层计算成为处理时间序列数据以及非线性系统建模等任务的良好选择。

研究团队综合考量理论、算法和实验结果,提出了一个整体性的储层计算方法论,意图缩小当前研究与工业应用之间存在的差距。尽管储层计算在理论和试验方面取得显著成果,但其在工业界广泛应用却相对有限,主要原因是缺乏能够广泛处理实际问题的“杀手级”应用。

图1 储层计算研究的里程碑,包括系统和算法设计、理论、实验实现以及应用。

详情请见:计算神经科学读书会启动:从复杂神经动力学到类脑人工智能

点击“阅读原文”,报名读书会