图网络未来几何?12位学者寄望2021大爆发

导语

近段时间,图神经网络(GNN)作为机器学习最热门的领域之一,唱盛有之,唱衰也不少。就在前两天,一位数据科学家发表了一篇题为“为什么我对GNN不感冒”的文章,历数 GNN 的多项弊端,在reddit上引发广泛讨论。但尽管如此,GNN作为一项方兴未艾的研究领域,在 2020年依然取得了诸多进展,在2021年也依然存在许多亟待挖掘的课题。

Michael Bronstein | 作者

智源社区 | 来源

近段时间,图神经网络(GNN)作为机器学习最热门的领域之一,唱盛有之,唱衰也不少。 就在前两天,一位数据科学家发表了一篇题为“为什么我对GNN不感冒”的文章,历数 GNN 的多项弊端,在reddit上引发广泛讨论。 过去5年中,大多数GNN论文提供的结果,对从业者没有太多帮助。糟糕的图数据结构全局方法,是个死胡同….. 但尽管如此,GNN作为一项方兴未艾的研究领域,在 2020年依然取得了诸多进展,在2021年也依然存在许多亟待挖掘的课题。 在新年伊始,以色列计算机科学家 Michael Bronstein 征求了 12 位在Graph ML及其应用领域做出杰出工作的研究人员的意见,对过去一年 GML 领域的亮点进行了总结,并预测了2021年的发展,内容涉及GNN研究的方方面面。

1.消息传递的限制

Will Hamilton,麦吉尔大学的助理教授,蒙特利尔 CIFAR 主席,GraphSAGE 作者。

Will Hamilton,麦吉尔大学的助理教授,蒙特利尔 CIFAR 主席,GraphSAGE 作者。

Will Hamilton:

2020年,图机器学习领域面临着消息传递模式的基本限制。 这些限制包括所谓的“瓶颈”问题,过度平滑问题,以及表征能力理论上的限制。展望未来,我希望在2021年,我们能够为图机器学习寻找下一个重要的范例。我不确定下一代图机器学习算法到底会是什么样子,但我相信,要想取得进展,就需要打破2020年及之前统治该领域的消息传递模式。

我也希望,2021年图机器学习也能进入更有影响力和更具挑战性的应用领域。最近有太多的研究集中在简单、同质的节点分类任务上。我也希望在需要更复杂的算法推理任务上看到方法上的进步,比如涉及知识图表、强化学习和组合优化的任务。

2.算法推理

Petar Veličković,DeepMind 高级研究员,Graph Attention Networks)作者

Petar Veličković,DeepMind 高级研究员,Graph Attention Networks)作者

Petar Veličković:

2020已经决定性地、不可逆转地将图表征学习变成了机器学习的“第一公民”。

今年在该领域取得的巨大进展数不胜数,无法一一列举,但我个人最为兴奋的要属神经算法推理。传统上,神经网络在插值机制中是非常强大的,但众所周知,神经网络是可怕的外推器,推理能力严重不足;推理的主要特征之一,就是能够发挥OOD的功能。

推理任务对于 GNN 的未来发展来讲可能是十分理想的,不仅因为它们与这类任务非常契合,还因为许多现实世界的图任务表现出趋同性,这意味着最有影响力和可扩展的方法通常是更简单形式的GNN。

基于先前神经执行器过往的成功案例,如神经图灵机和可微分神经计算机(DNC),再加上现在无处不在的图机器学习工具箱,2020年发表的几项相关工作探索了神经执行器的理论极限,基于 GNNs 衍生出新颖而强大的推理结构,并在神经推理任务上展现出强大的泛化能力。 尽管这样的架构自然可以在2021年实现组合优化,但我个人最感到兴奋的是,预训练的算法执行器可以让我们将经典算法应用于过于原始或者不适合该算法的输入。 例如,我们的 XLVIN 代理恰恰使用了这些概念,以允许 GNN 在强化学习 pipeline 中执行值迭代样式的算法,即使不知道底层 MDP 的细节。我相信2021年的时机已经成熟,GNN 应用程序将普遍应用于强化学习。

3.关系结构发现

Thomas Kipf,Google Brain 科学家,图卷积网络的作者

Thomas Kipf,Google Brain 科学家,图卷积网络的作者

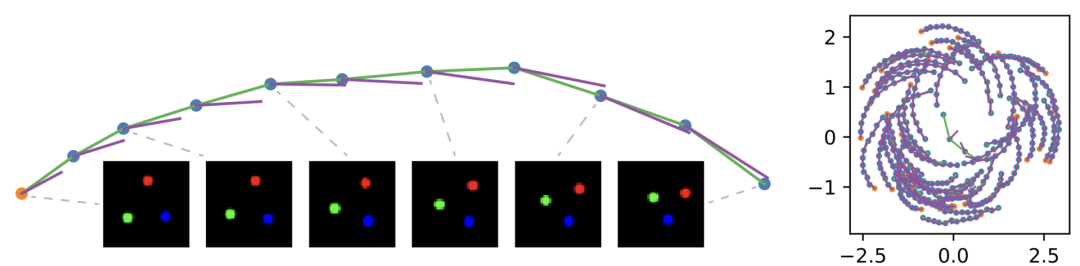

Thomas Kipf: 自从基于GNN的模型被广泛采用以来,Graph ML社区中一个特别值得注意的趋势便是将计算结构与数据结构分离。

在最近的一次ICML研讨会的演讲中,我将这种趋势称为“关系结构发现”。  GNNs 允许学习一个状态转换图(右侧),来解释复杂的多粒子系统(左侧)。 通常我们设计的图神经网络,是为了在数据集提供的一个固定(或随时间演进)结构上去传递消息。也即,将数据集的节点和边缘作为模型计算结构或消息传递结构的黄金标准。

GNNs 允许学习一个状态转换图(右侧),来解释复杂的多粒子系统(左侧)。 通常我们设计的图神经网络,是为了在数据集提供的一个固定(或随时间演进)结构上去传递消息。也即,将数据集的节点和边缘作为模型计算结构或消息传递结构的黄金标准。

但在2020年,有许多研究开始对能够适应计算结构的模型产生兴趣。这些模型超越了简单的基于注意力的模型,可以动态地选择使用哪些组件作为节点以及在哪些节点上进行消息传递。 比较有影响的例子包括 摊销因果发现(Amortised Causal Discovery) [19–20],这项研究利用了神经关系推理从时间序列数据中推断因果图,并用它来做推理。具有科学系指针的GNN[21,15];关联机制[22,23];学习具有自适应计算图的基于网格的物理模拟器[24]学习推断抽象节点的模型[25,26] 这个方向的探索的意义显而易见,因为它使我们能够有效利用其它领域(例如文本或视频处理)中的GNN架构提供的对称性(例如节点置换方差)和归纳偏差(例如成对交换函数建模)。 展望下未来,我比较期待的进展是:在不依赖明确监督的情况下,给定一些数据和任务,能够学习出最佳的计算图结构(不管是节点还是关系)。 一个好处是,对学习到的这种结构进行探究,我们可以对学到的模型如何解决某个任务做可解释性分析,也可以让我们对因果推理做进一步的类比。

4.表示能力

Haggai Maron,英伟达的科学家,可表示的高维图神经网络(expressive high-dimensioanl graph neural networks)的作者

Haggai Maron,英伟达的科学家,可表示的高维图神经网络(expressive high-dimensioanl graph neural networks)的作者

Haggai Maron:

图神经网络的表达能力是2020年Graph ML的核心主题之一。 当下有许多优秀的论文,讨论了:

各种GNN架构的表达能力;

当GNN的深度和宽度受限时的表达极限;

使用GNN哪些类型的结构可以进行检测和计数;

使用固定数量的GNN对许多图任务是无效的,因此建议使用迭代GNN来学习自适应终止消息传递过程。

2021年,我希望看到的进展包括:图生成模型的原理方法;

使用GNN的图匹配和GNN的表达能力之间的联系;

学习图像、语音等结构数据的图;

在scene graphs上,GNN社区和CV社区能够建立更多的合作。

5.可扩展性

Matthias Fey,多特蒙德工业大学博士,PyTorch几何图和开放图基准测试的开发者

Matthias Fey,多特蒙德工业大学博士,PyTorch几何图和开放图基准测试的开发者

Matthias Fey:

2020年Graph ML研究中最热门的主题之一是解决GNN的可扩展性问题。

在可扩展性方面,有几种方法采用将预测与传播解耦,来简化基础计算过程。

我们也看到有不少论文只是简单地将不可训练的传播策略和graph-agnostic(图不可知)模块结合在一起,用作预处理[30,7]或后处理[6]的步骤。这种方式得到了极好的结果,并且能够显著提高同构图的同等性能。

随着数据集越来越大,我们希望能够看到这方面的进一步发展,以及如何以可扩展的方式来利用可训练的表示的传播。

6.动态图

Emanuele Rossi,Twitter机器学习研究员,帝国理工学院博士,Temporal Graph Networks作者。

Emanuele Rossi,Twitter机器学习研究员,帝国理工学院博士,Temporal Graph Networks作者。

Emanuele Rossi:

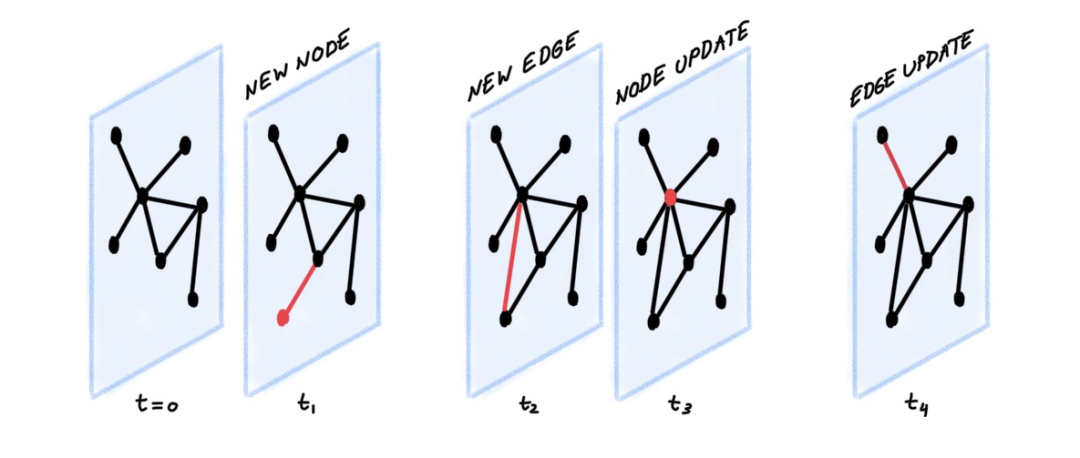

许多有趣的Graph ML应用本质上都是动态的,这种动态包括图拓扑以及属性随时间的演变。 动态图

动态图

在社交网络、金融交易网络或用户项目交互网络中,图网络都是动态的。但直到最近,对Graph ML的绝大多数研究都集中在静态图上,而一些尝试处理动态图的工作也主要是离散时间的动态图(即固定时间间隔的一系列静态图)。 2020年,我们看到有一些关于连续时间动态图的工作,这里将动态图视为事件的异步流。也有一些将动态图模型成功应用的案例,例如假账户检测,欺诈检测,流行病传播控制。 我个人认为,这个领域仍然处于探索阶段,仍然有许多有趣的问题尚未得到解答。比较重要的问题包括 动态图的可扩展性;

对动态模型的理论解释;

单个框架中如何更好地结合信息的时空扩散;

如何构建更可靠、更具挑战性的基准,从而确保可以更好地评估和跟踪研究进展;

如何将动态图神经架构应用到更多的行业场景中等。

7.新的硬件

Mark Saroufim,Graphcore的机器学习工程师

Mark Saroufim:

在与我合作过的客户中,几乎所有人都在生产过程中部署过图神经网络,或者至少是在计划这样做。 在NLP、蛋白质设计和分子特性预测等领域中,人们往往会把语言、蛋白质或者分子直接当做序列进行处理,以适应当下技术比较成熟的机器学习模型,例如Transformers。但Transformers 本质上就是有着多头注意力的 GNN。 半导体公司Graphcore,正在开发用于图数据的新硬件。

半导体公司Graphcore,正在开发用于图数据的新硬件。

在计算机领域,某些算法之所以获胜,并不是因为它们非常适合解决某个问题,而是因为它们在现有硬件上运行良好,这种现象称之为“硬件彩票”(Hardware Lottery)—— Transformers 能运行在 GPU 上就是这种情况。 在 Graphcore上,我们构建了一个有1472个核的 MIMD 架构,可以并行运行8832个程序,我们称之为智能处理单元(IPU)。这种架构非常适合 GNN 加速。Graphcore 的软件栈利用稀疏性将计算图的不同节点分配给不同的核。 对于可以纳入 IPU 900MB 芯片存储的模型,我们的架构通过 GPU 实现了吞吐量的实质性改进;此外,只需几行代码,就可以将模型分发到数千个 GPU 上。 我很高兴看到我们的用户利用我们的架构做了大量的研究,包括各类应用,例如 SLAM 中的光束法平差,使用本地更新训练深层网络,或者解决粒子物理学中的各种问题。我希望在2021年看到更多研究人员利用我们先进的机器学习硬件。

8.工业应用

Sergey Ivanov,Criteo科学家 Sergey Ivanov: 对于Graph ML研究来说,这是令人震惊的一年。在所有主要的ML会议上,有关图神经网络的论文中约占全部的 10%至20%。在这种规模下,每个人都可以找到自己感兴趣且有趣的研究进展。 在NeurIPS 2020上,谷歌的图挖掘团队全方位介绍了他们在产品中如何使用Graph ML,在312页的slide里,他们介绍了他们利用时空GNN建模COVID-19、欺诈检测、隐私保护等方面的应用工作。

Sergey Ivanov,Criteo科学家 Sergey Ivanov: 对于Graph ML研究来说,这是令人震惊的一年。在所有主要的ML会议上,有关图神经网络的论文中约占全部的 10%至20%。在这种规模下,每个人都可以找到自己感兴趣且有趣的研究进展。 在NeurIPS 2020上,谷歌的图挖掘团队全方位介绍了他们在产品中如何使用Graph ML,在312页的slide里,他们介绍了他们利用时空GNN建模COVID-19、欺诈检测、隐私保护等方面的应用工作。

另外,DeepMind利用GNN在谷歌地图中做了全球旅行时间预测,这个工作一个有趣的细节是,将强化学习模型集成到一个batch中,选择相似的采样子图来训练GNN的参数,这种超参调整能使实时到达时间估算的精度提高50%以上。 SuperGlue,使用GNN解决了计算机视觉中的特征匹配问题。

SuperGlue,使用GNN解决了计算机视觉中的特征匹配问题。

另一个比较有趣的应用来自 Magic Leap,这家公司专门研究3D图形生成。他们将SuperGlue架构[39]应用到了图像特征匹配(这是3D重建、位置识别、定位和映射的重要课题)上。这种端到端的特征表示,与最佳运输优化相结合,在实时的室内和室外姿态估计上表现极佳。

这些当然只是GNN在2020年工业应用的一个缩影。在2021年,我们会在工业中看到更多Graph ML的身影,例如生产流程和框架、新的开源图数据集、电子商务、工程设计、制药等,都会有GNN的大规模部署。

9.在物理学中的应用

Kyle Cranmer,纽约大学物理学教授,希格斯玻色子的发现者之一

Kyle Cranmer,纽约大学物理学教授,希格斯玻色子的发现者之一

Kyle Cranmer:

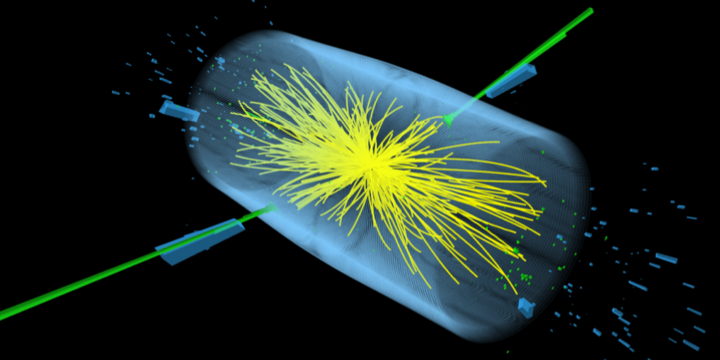

看到图机器学习在过去两年中在物理领域变得非常流行,真是太神奇了。 早期在粒子物理中使用深度学习,通常的做法是,把各种数据转换成图像的表示形式,然后输入到CNN中,这整个过程是极为不自然的,因为我们的数据本身并非网格状的,表示成图像会非常稀疏。图,对我们的数据来说,则是一个非常自然的表示形式。 粒子喷射可以表示为一个图。研究人员正在探索使用GNN来检测粒子物理学中的发现。图片来源:LHC

粒子喷射可以表示为一个图。研究人员正在探索使用GNN来检测粒子物理学中的发现。图片来源:LHC

大型强子对撞机的研究人员现在正在努力将图机器学习集成到每秒处理数十亿次碰撞的实时数据处理系统当中。研究人员正在努力通过部署推理服务器将图机器学习与实时数据采集系统集成在一起,并试图在FPGA和其他特殊硬件上实现这些算法。 Graph ML 在2020年的另一个亮点是证明其归纳偏置可以与符号方法配对。 例如,我们使用GNN来学习预测各种动力学系统,然后对沿着边发送的消息进行符号回归。我们不仅能够复现那些已知动力系统的力学规律,而且能够获知那些完全不知道规律的系统的力学方程。 此外,获得的这些方程还可以放到GNN中,更新原始的学习组建,从而来更好地归纳分布数据。

10.医学中的应用

Anees Kazi,慕尼黑工业大学的博士生 ,曾撰写了多篇有关 Graph ML 在医学成像中应用的论文。

Anees Kazi,慕尼黑工业大学的博士生 ,曾撰写了多篇有关 Graph ML 在医学成像中应用的论文。

Anees Kazi:

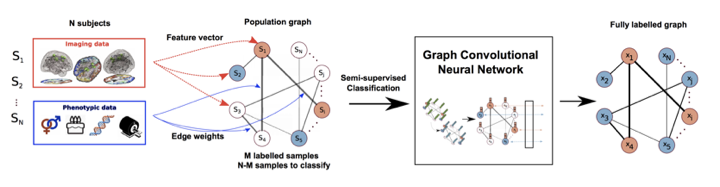

在医学领域,Graph ML改变了分析多模态数据的方式,这种方式与专家如何通过临床常规中的所有可用维度观察患者的状况非常相似。 最近,在医学成像和医疗保健应用中,与Graph ML相关的研究出现了大爆发,包括脑区图像分割,以及使用针对疾病预测的MRI / fMRI数据进行脑结构分析和药物作用分析。 GNN 可以利用人口图进行疾病分类

GNN 可以利用人口图进行疾病分类

说起2020年,Graph ML在医学领域中的应用,有以下方面脱颖而出。 首先,潜图学习,通过给定数据来经验性定义一个图的潜图学习之前是优化结果的瓶颈,但现在已经被自动学习潜图结构的方法解决了。其次,数据重建,因为数据丢失是医学领域许多数据集的一个常见问题,因此基于图的方法可以根据邻近图的关系完成数据重建。第三,Graph ML模型的可解释性,对于临床和技术专家来说,重点在于推理出Graph ML模型的结果,并将其可靠地合并到CAD系统(计算机辅助检测)中。2020年医学领域的另一个重要亮点当然是新冠,并且使用Graph ML方法检测Covid-19。 到2021年,Graph ML可以用于进一步提升ML模型的可解释性,从而做出更好的决策。其次,研究人员观察到 Graph ML方法仍然对图结构敏感,因此,针对图扰动和对抗攻击的鲁棒性是重要的议题。最后,将自监督学习与Graph ML的集成应用于医疗领域将会是很有趣的。

11.蛋白质结构预测

Bruno Correia,瑞士洛桑联邦理工学院助理教授、蛋白质设计和免疫工程实验室负责人,MaSIF的开发商之一。

Bruno Correia,瑞士洛桑联邦理工学院助理教授、蛋白质设计和免疫工程实验室负责人,MaSIF的开发商之一。

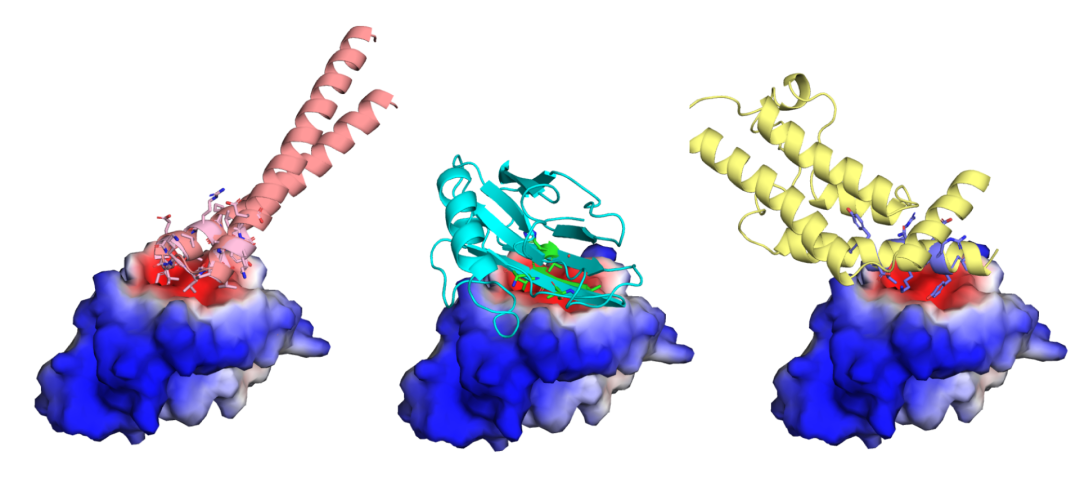

2020年,蛋白质结构预测取得了令人兴奋的进展,这是生物信息学中的关键问题。 对于蛋白质来说,其分子表面的化学和几何模式直接影响其功能。  使用几何机器学习架构MaSIF设计的不同蛋白结合剂,用于肿瘤靶向治疗。

使用几何机器学习架构MaSIF设计的不同蛋白结合剂,用于肿瘤靶向治疗。

基于分子表面表示的研究,已经有数十年了,也同时给机器学习带来了极大的挑战。 其中让人比较印象深刻的研究是几何深度学习的方法,这种方法能够处理不规则数据,特别适合蛋白质的表示。在MASIF中,在基于网格的分子表面表示上,使用几何深度学习进行训练,可以学习到可预测蛋白质和其他分子相互作用的模式,而且可以将计算速度提升几个数量级。反过来,这也可以促进更大范围的蛋白质-蛋白质相互作用网络的预测。 在MASIF框架的基础上,我们做到了动态生成化学和表面模式,从而避免了所有预计算的阶段。我们预计,这些进展将为蛋白质和小分子设计带来变革,长远来看,将有助于更快地开发生物药物。

12.生命科学

Marinka Zitnik,哈佛医学院生物医学信息学助理教授,Decagon系统的作者。

Marinka Zitnik,哈佛医学院生物医学信息学助理教授,Decagon系统的作者。

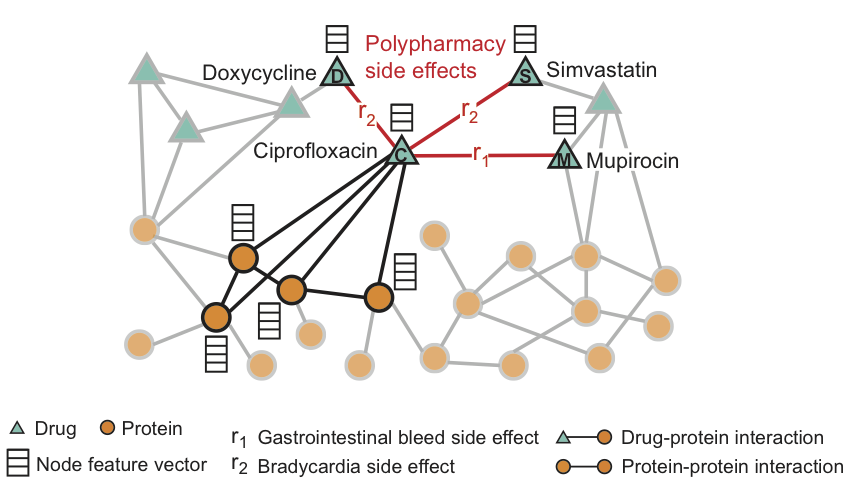

Marinka Zitnik: 很高兴看到Graph ML在2020年进入到生命科学领域。 我们已经看到,图神经网络在精心设计的基准数据集上可以胜过传统方法,另一方面,在新药开发上,也从根本上开辟了一条新的途径。比较显著的进展包括单细胞生物学、蛋白质和结构生物学,药物发现和重定位等。  在Decagon中使用GNN,来预测药物的副作用。

在Decagon中使用GNN,来预测药物的副作用。

几个世纪以来,科学家所使用的科学方法一直保持不变。我们希望,在2021年,我们能够利用Graph ML 对这一现象做出一些实质性的进展。 因此,我认为,我们需要设计出一种方法,能够优化和操纵网络系统,然后预测其结果;基于这种方法,我们可以通过微扰和干预数据来控制实验,而数据本身不需要我们在现实世界中进行观测) 另外,我希望我们可以开发出更多的方法来学习可操作的表示形式,这些方法可以更加容易地应用到科学中的可操作的假设中,从而避免在高风险环境(例如化学测试、粒子物理、临床试验等)中进行决策,还能获得更有意义的精确解释以及可靠的预测。

原文地址:

https://towardsdatascience.com/predictions-and-hopes-for-graph-ml-in-2021-6af2121c3e3d

参考资料

[1] U. Alon and E. Yahav, On the bottleneck of graph neural networks and its practical implications (2020) arXiv:2006.05205.

[2] Q. Li, Z. Han, X.-M. Wu, Deeper insights into graph convolutional networks for semi-supervised learning (2019) Proc. AAAI.

[3] K. Xu et al. How powerful are graph neural networks? (2019) Proc. ICLR.

[4] C. Morris et al. Weisfeiler and Leman go neural: Higher-order graph neural networks (2019) Proc. AAAI.

[5] K. Xu et al. What can neural networks reason about? (2019) arXiv:1905.13211.

[6] Q. Huang et al. Combining label propagation and simple models out-performs graph neural networks (2020) arXiv:2010.13993.

[7] F. Frasca et al. SIGN: Scalable Inception Graph Neural Networks (2020) arXiv:2004.11198.

[8] A. Graves, G. Wayne, and I. Danihelka, Neural Turing Machines (2014) arXiv:1410.5401.

[9] A. Graves et al. Hybrid computing using a neural network with dynamic external memory (2016). Nature 538:471–476.

[10] G. Yehuda, M. Gabel, and A. Schuster. It’s not what machines can learn, it’s what we cannot teach (2020) arXiv:2002.09398.

[11] K. Xu et al. How neural networks extrapolate: From feedforward to graph neural networks (2020) arXiv:2009.11848.

[12] P. Veličković et al., Neural execution of graph algorithms (2019) arXiv:1910.10593.

[13] O. Richter and R. Wattenhofer, Normalized attention without probability cage (2020) arXiv:2005.09561.

[14] H. Tang et al., Towards scale-invariant graph-related problem solving by iterative homogeneous graph neural networks (2020) arXiv:2010.13547.

[15] P. Veličković et al. Pointer Graph Networks (2020) Proc. NeurIPS.

[16] Y. Yan et al. Neural execution engines: Learning to execute subroutines (2020) Proc. ICLR.

[17] C. K. Joshi et al. Learning TSP requires rethinking generalization (2020) arXiv:2006.07054.

[18] A. Deac et al. XLVIN: eXecuted Latent Value Iteration Nets (2020) arXiv:2010.13146.

[19] S. Löwe et al., Amortized Causal Discovery: Learning to infer causal graphs from time-series data (2020) arXiv:2006.10833.

[20] Y. Li et al., Causal discovery in physical systems from videos (2020) Proc. NeurIPS.

[21] D. Bieber et al., Learning to execute programs with instruction pointer attention graph neural networks (2020) Proc. NeurIPS.

[22] A. Kazi et al., Differentiable Graph Module (DGM) for graph convolutional networks (2020) arXiv:2002.04999

[23] D. D. Johnson, H. Larochelle, and D. Tarlow., Learning graph structure with a finite-state automaton layer (2020). arXiv:2007.04929.

[24] T. Pfaff et al., Learning mesh-based simulation with graph networks (2020) arXiv:2010.03409.

[25] T. Kipf et al., Contrastive learning of structured world models (2020) Proc. ICLR

[26] F. Locatello et al., Object-centric learning with slot attention (2020) Proc. NeurIPS.

[27] W. Azizian and M. Lelarge, Characterizing the expressive power of invariant and equivariant graph neural networks (2020) arXiv:2006.15646.

[28] A. Loukas, What graph neural networks cannot learn: depth vs width (2020) Proc. ICLR.

[29] Z. Chen et al., Can graph neural networks count substructures? (2020) Proc. NeurIPS.

[30] A. Bojchevski et al., Scaling graph neural networks with approximate PageRank (2020) Proc. KDD.

[31] E. Rossi et al., Temporal Graph Networks for deep learning on dynamic graphs (2020) arXiv:2006.10637.

[32] S. Kumar, X. Zhang, and J. Leskovec, Predicting dynamic embedding trajectory in temporal interaction networks (2019) Proc. KDD.

[33] R. Trivedi et al., DyRep: Learning representations over dynamic graphs (2019) Proc. ICLR.

[34] D. Xu et al., Inductive representation learning on temporal graphs (2019) Proc. ICLR.

[35] M. Noorshams, S. Verma, and A. Hofleitner, TIES: Temporal Interaction Embeddings for enhancing social media integrity at Facebook (2020) arXiv:2002.07917.

[36] X. Wang et al., APAN: Asynchronous Propagation Attention Network for real-time temporal graph embedding (2020) arXiv:2011.11545.

[37] E. A. Meirom et al., How to stop epidemics: Controlling graph dynamics with reinforcement learning and graph neural networks (2020) arXiv:2010.05313.

[38] S. Hooker, Hardware lottery (2020), arXiv:2009.06489.

[39] P. E. Sarlin et al., SuperGlue: Learning feature matching with graph neural networks (2020). Proc. CVPR.

[40] S. Ruhk et al., Learning representations of irregular particle-detector geometry with distance-weighted graph networks (2019) arXiv:1902.07987.

[41] J. Shlomi, P. Battaglia, J.-R. Vlimant, Graph Neural Networks in particle physics (2020) arXiv:2007.13681.

[42] J. Krupa et al., GPU coprocessors as a service for deep learning inference in high energy physics (2020) arXiv:2007.10359.

[43] A. Heintz et al., Accelerated charged particle tracking with graph neural networks on FPGAs (2020) arXiv:2012.01563.

[44] M. Cranmer et al., Discovering symbolic models from deep learning with inductive biases (2020) arXiv:2006.11287. Miles Cranmer is unrelated to Kyle Cranmer, though both are co-authors of the paper. See also the video presentation of the paper.

[45] Q. Cai et al., A survey on multimodal data-driven smart healthcare systems: Approaches and applications (2020) IEEE Access 7:133583–133599

[46] K. Gopinath, C. Desrosiers, and H. Lombaert, Graph domain adaptation for alignment-invariant brain surface segmentation (2020) arXiv:2004.00074

[47] J. Liu et al., Identification of early mild cognitive impairment using multi-modal data and graph convolutional networks (2020) BMC Bioinformatics 21(6):1–12

[48] H. E. Manoochehri and M. Nourani, Drug-target interaction prediction using semi-bipartite graph model and deep learning (2020). BMC Bioinformatics 21(4):1–16

[49] Y. Huang and A. C. Chung, Edge-variational graph convolutional networks for uncertainty-aware disease prediction (2020) Proc. MICCAI

[50] L. Cosmo et al., Latent-graph learning for disease prediction (2020) Proc. MICCAI

[51] G. Vivar et al., Simultaneous imputation and disease classification in incomplete medical datasets using Multigraph Geometric Matrix Completion (2020) arXiv:2005.06935.

[52] X. Li and J. Duncan, BrainGNN: Interpretable brain graph neural network for fMRI analysis (2020) bioRxiv:2020.05.16.100057

[53] X. Yu et al., ResGNet-C: A graph convolutional neural network for detection of COVID-19 (2020) Neurocomputing.

[54] P. Gainza et al., Deciphering interaction fingerprints from protein molecular surfaces using geometric deep learning (2020) Nature Methods 17(2):184–192.

[55] F. Sverrisson et al., Fast end-to-end learning on protein surfaces (2020) bioRxiv:2020.12.28.424589.

[56] A. Klimovskaia et al., Poincaré maps for analyzing complex hierarchies in single-cell data (2020) Nature Communications 11.

[57] J. Jumper et al., High accuracy protein structure prediction using deep learning (2020) a.k.a. AlphaFold 2.0 (paper not yet available).

[58] J. M. Stokes et al., A deep learning approach to antibiotic discovery (2020) Cell 180(4):688–702.

[59] D. Morselli Gysi et al., Network medicine framework for identifying drug repurposing opportunities for COVID-19 (2020) arXiv:2004.07229.

(可上下滑动浏览)

复杂科学最新论文

集智斑图顶刊论文速递栏目上线以来,持续收录来自Nature、Science等顶刊的最新论文,追踪复杂系统、网络科学、计算社会科学等领域的前沿进展。现在正式推出订阅功能,每周通过微信服务号「集智斑图」推送论文信息。扫描下方二维码即可一键订阅:

推荐阅读

图神经网络前沿综述:动态图网络

DeepMind再发Nature解决物理难题,图神经网络展示强大能力

PM2.5-GNN 图网络雾霾预报模型:复杂系统自动建模在大气污染中的应用

点击“阅读原文”,追踪复杂科学顶刊论文