生成流网络:基于网络采样扩展搜索空间 | GFlowNet 最新研究梳理

导语

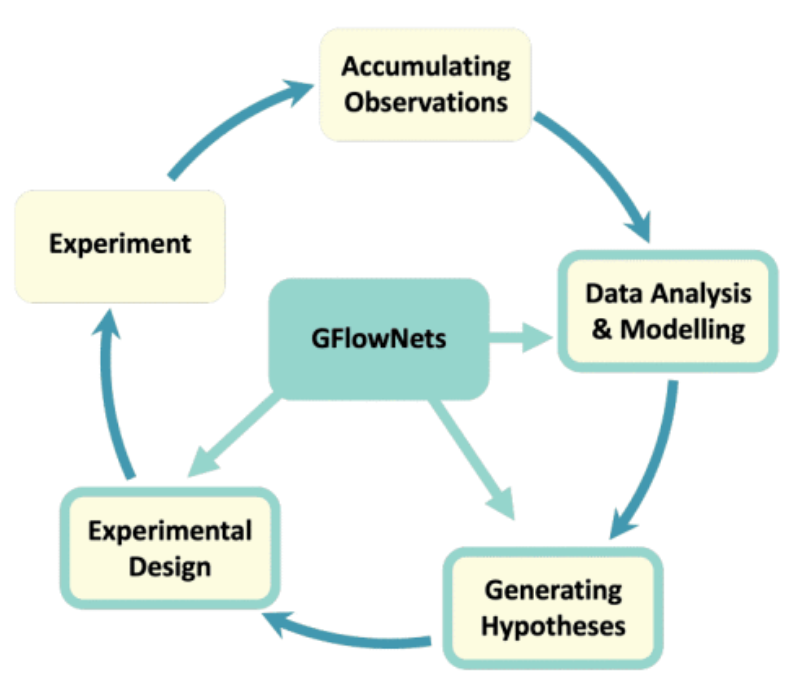

生成流网络(GFlowNet)是一种新的概率机器学习框架,和强化学习同层次,可以应用于实验科学循环的建模、假设生成和实验设计阶段。在集智俱乐部「AI+Science」读书会,Mila 研究所和蒙特利尔大学在读博士张鼎怀综述介绍了GFlowNet框架。本文从张鼎怀博士的 Github 推荐中精选了部分论文和资料,介绍近期生成流网络的研究前沿,希望帮助大家了解这一领域的最新进展。

靳秋野 | 作者

张鼎怀 | 审校

梁金 | 编辑

生成流网络(GFlowNet,GFN)是由 Yoshua Bengio 教授和他的团队于2021年提出的一种生成模型,用于从给定的奖励函数中采样多样性高的候选对象。例如,在设计新分子的时候,我们希望能够生成一系列具有高奖励(如稳定性、活性等)的分子结构。传统的最大化回报的方法,如强化学习(Reinforcement Learning,RL),往往会收敛到单一的最优解,而忽略了其他可能的高回报解;马尔可夫链蒙特卡罗法(Markov Chain Monte Carlo,MCMC)虽然可以从一个能量函数中生成分布,但是计算代价高昂且只能进行局部探索。

相较于 RL 和 MCMC 方法,GFlowNet 的优势在于可以生成多样化的高回报解;同时,GFlowNet 利用了时序差分学习的思想,将生成过程视为一个流网络,可以处理不同轨迹产生相同最终状态的情况。例如,在生成某个分子图时,有多种方式可以逐步添加原子。GFlowNet 将轨迹集合视为一个流,并将流一致性方程转化为一个学习目标,类似于将贝尔曼方程转化为时序差分方法。

经过 Bengio 及其团队的不懈努力,GFlowNet 已在不同任务上展示了有效性和优越性,例如可以用于估计联合概率分布、边缘概率分布、熵、互信息、Pareto前沿、奖励最大化策略等,展示了生成流网络的灵活性和通用性。

本文旨在介绍近期生成流网络的研究前沿,其中的论文和资料等选自Mila研究所和蒙特利尔大学张鼎怀博士的 Github 推荐,希望帮助大家了解这一领域的最新进展。

张鼎怀的 Github: https://github.com/zdhNarsil/Awesome-GFlowNets

论文题目:DynGFN: Bayesian Dynamic Causal Discovery using Generative Flow Networks 论文链接:

https://arxiv.org/abs/2302.04178

作者:Lazar Atanackovic, Alexander Tong, Jason Hartford, Leo J. Lee, Bo Wang, Yoshua Bengio [Mila – The Quebec AI Institute]

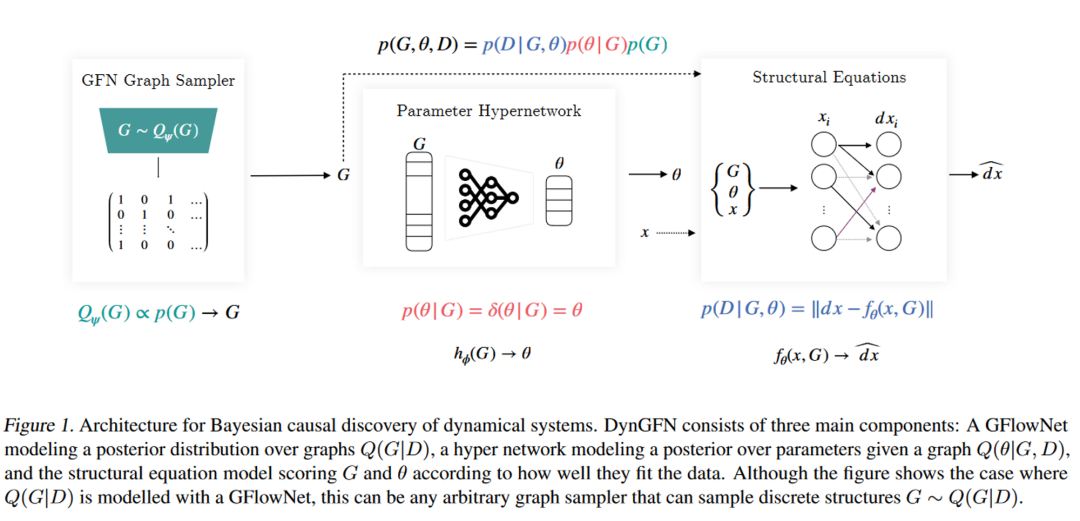

背景:科学发现的一个核心问题,是从可观测数据中学习潜在的因果结构。贝叶斯因果发现方法通过在给定先验和观察的可接受图集上学习后验来解决这个问题。

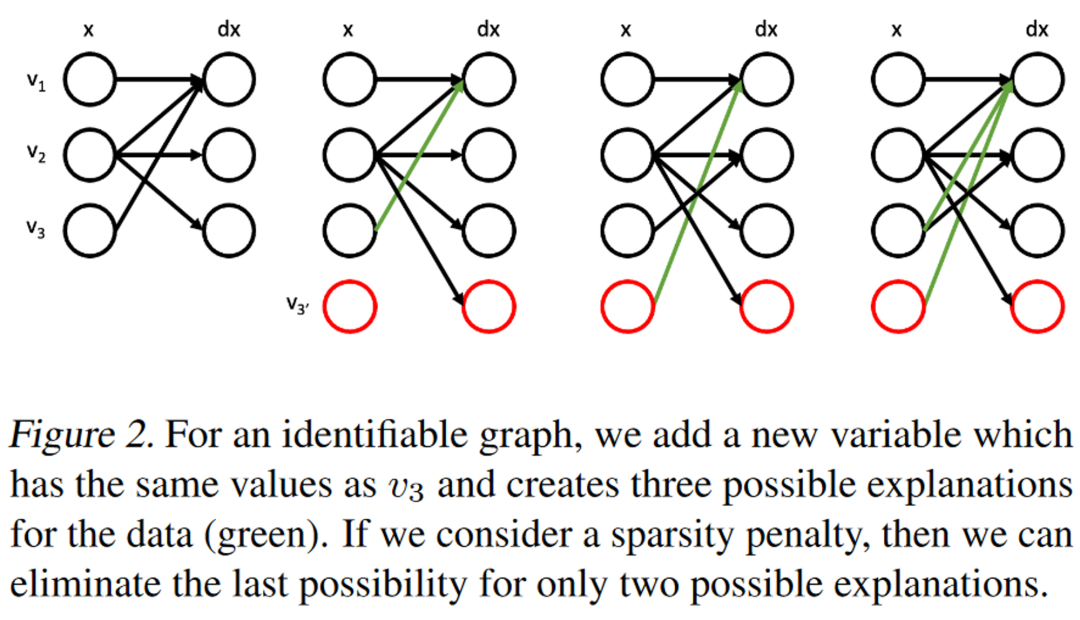

动机:现有的方法主要考虑静态系统的观测数据,并假设潜在的因果结构采用有向无环图(directed acyclic graph, DAG)的形式。然而,在具有动态反馈机制调节单个变量轨迹的情况下,这种无环性假设会失效,除非可以考虑时间因素。

方法:本文提出一种名为 DynGFN 的贝叶斯动态因果发现方法,它使用生成流网络来处理具有动态反馈机制的系统中的因果结构。DynGFN 包括三个关键模块:1)图采样器,用于对编码观测变量之间因果依赖关系的图结构进行采样;2)生成流网络,用于建模后验分布;3)基于贝叶斯推断的算法,用于学习潜在的因果结构。

优势:1)可以处理具有动态反机制的系统中的因果结构,相比现有方法更加全面;2)可以处理具有环路的因果结构,相比现有方法更加灵活;3)可以对可能的解释结构建立后验分布,从而更好地模拟可能性分布;4)使用生成流网络来提高性能,相比现有方法更加高效;5)在单细胞 RNA 速度数据上进行了实证评估,并展示了在基因调控网络发现方面的应用。

论文题目:Generative Augmented Flow Networks 论文链接: https://arxiv.org/abs/2210.03308 作者:Ling Pan, Dinghuai Zhang, Aaron Courville, Longbo Huang, Yoshua Bengio [Mila – Quebec AI Institute & Tsinghua University]

ICLR 2023 spotlight

背景:生成流网络是一个概率框架,其中智能体学习用于对象生成的随机策略,使得生成对象的概率与给定的奖励函数成正比。与奖励最大化的强化学习方法相比,其有效性已在发现高质量和多样化的解决方案方面得到证实。

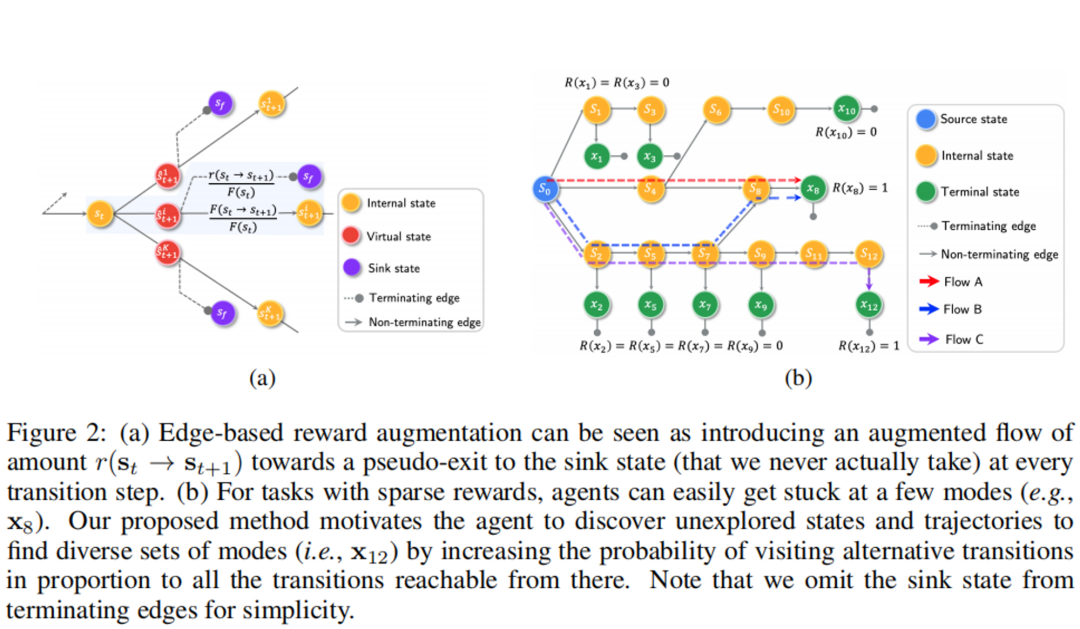

动机:由于GFlowNets只能从终端状态的奖励中学习,在稀疏奖励任务中容易陷入局部最优解,可能限制了其适用性。实际上,中间奖励在学习中起着关键作用,例如通过内在动机提供中间反馈,即使在特别具有挑战性的稀疏奖励任务中也是如此。

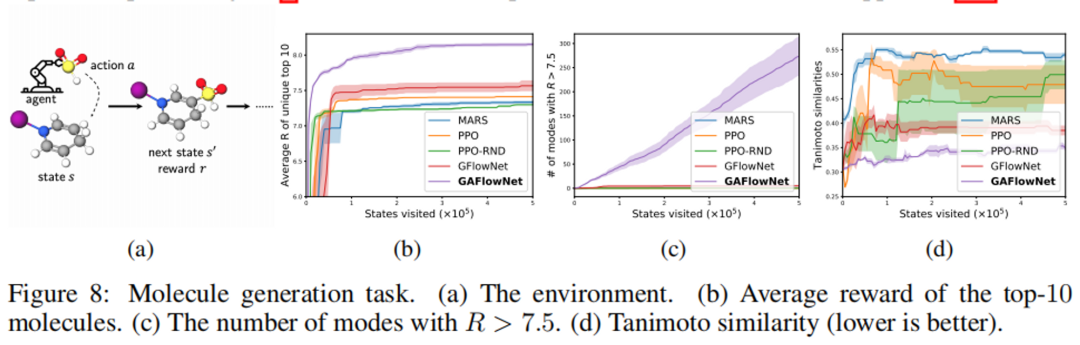

方法:本文提出了一种新的学习框架,称为生成式增强流网络(Generative Augmented Flow Networks, GAFlowNet)。该框架通过引入中间奖励来指导智能体在状态空间中进行探索。具体来说,作者使用内在动机来指定中间奖励,以解决稀疏奖励任务中的探索问题。

优势:1)通过引入中间奖励来指导智能体在状态空间中进行探索,可以解决稀疏奖励任务中的探索问题;2)使用内在动机来指定中间奖励,可以提高智能体的多样性和收敛性;3)理论上证明了该框架可以产生无偏差的解决方案;4)在GridWorld和分子领域上进行了广泛实验,证明了该框架的有效性,未来还可以扩展到复杂任务,如分子图生成。

一句话总结:本文提出了一种新的学习框架GAFlowNet,通过引入中间奖励来指导智能体在状态空间中进行探索,解决稀疏奖励任务中的探索问题,并在GridWorld和分子领域上进行了广泛实验,证明了该框架的有效性。

| MOGFNs:多目标生成流网络

论文题目:Multi-Objective GFlowNets 论文链接: https://arxiv.org/abs/2210.12765 作者:Moksh Jain, Sharath Chandra Raparthy, Alex Hernandez-Garcia, Jarrid Rector-Brooks, Yoshua Bengio, Santiago Miret, Emmanuel Bengio [Mila – The Quebec AI Institute]

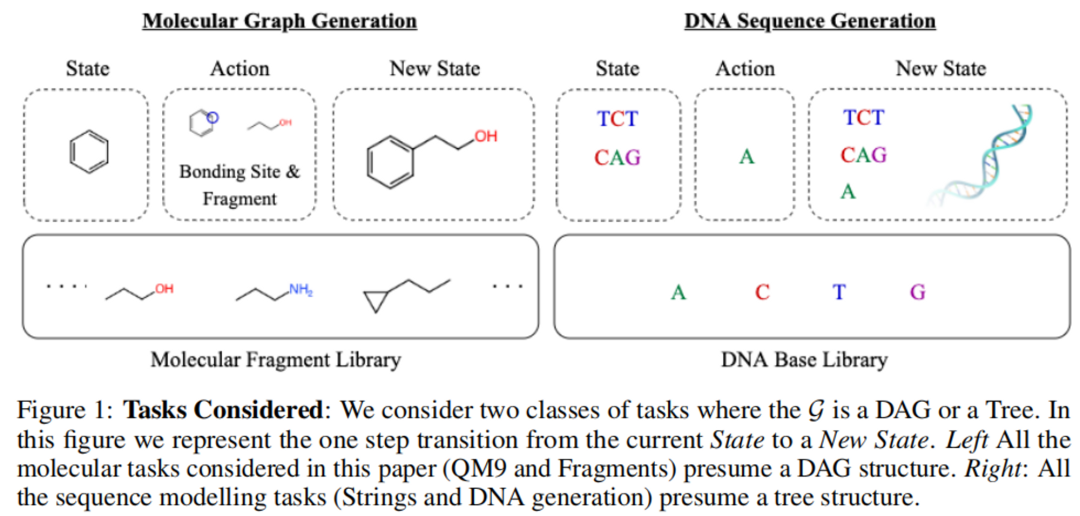

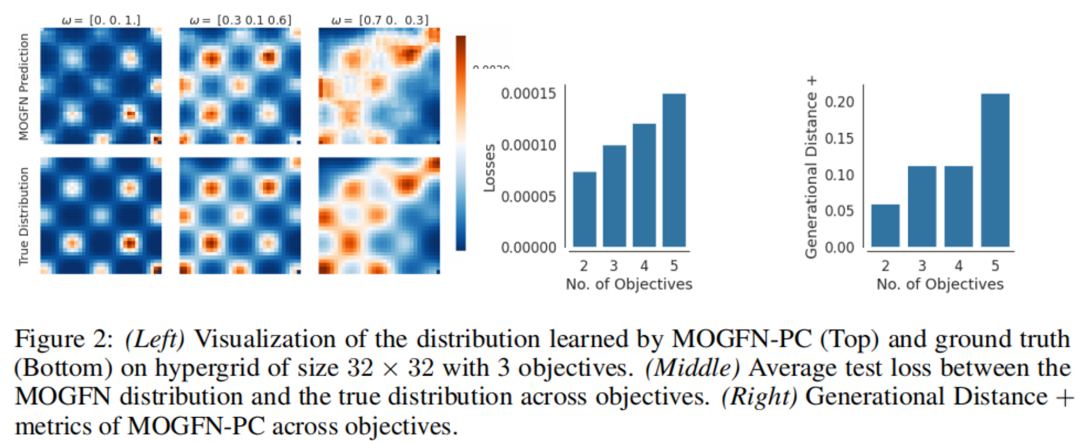

背景:在机器学习的许多应用中,如药物发现和材料设计,目标是生成同时最大化一组目标的候选项。由于这些目标经常是相互冲突的,所以没有一个候选项可以同时最大化所有目标,无法在不损害一个目标的情况下改善另一目标。此外,在实践中,这些目标往往是不明确的,使得候选项的多样性成为关键考虑因素。现有的多目标优化方法未能捕捉候选空间的多样性。

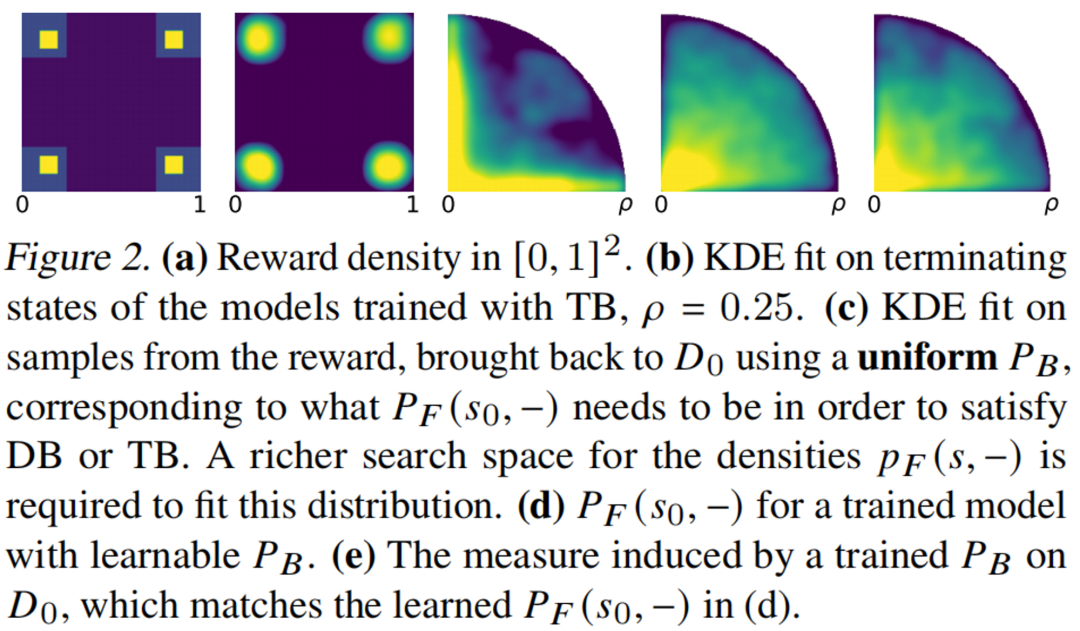

论文题目:A theory of continuous generative flow networks 论文链接: https://arxiv.org/abs/2301.12594 作者:Salem Lahlou, Tristan Deleu, Pablo Lemos, Dinghuai Zhang, Alexandra Volokhova, Alex Hernández-García, Léna Néhale Ezzine, Yoshua Bengio, Nikolay Malkin [Mila – The Quebec AI Institute]

一句话总结:本文提出了一种广义的生成流网络(GFlowNets)理论,可以处理连续或混合状态空间,并在实验中证明了其在连续空间中具有更好的性能表现。

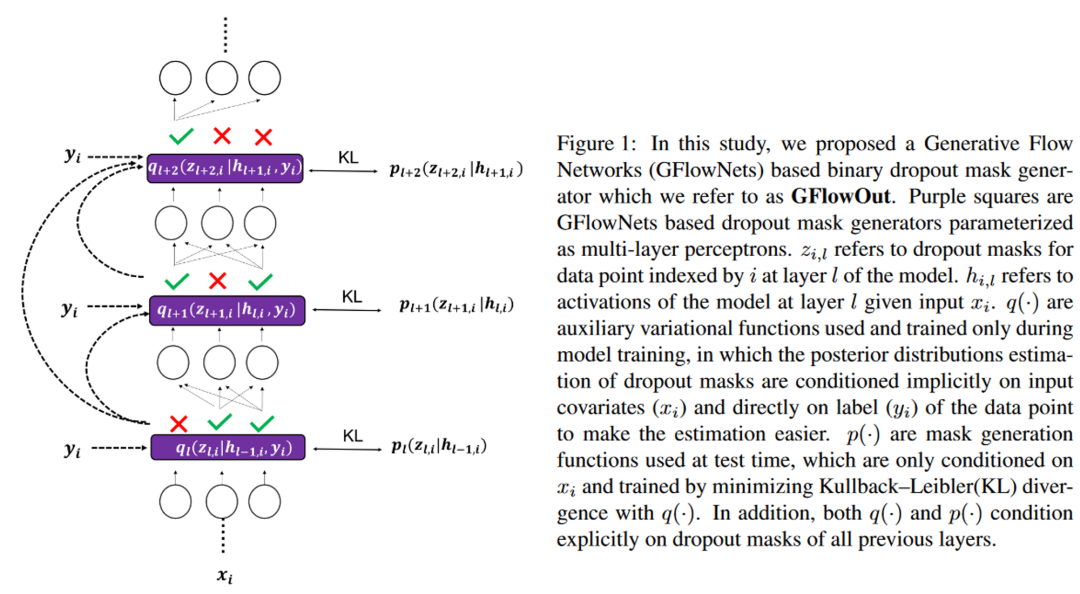

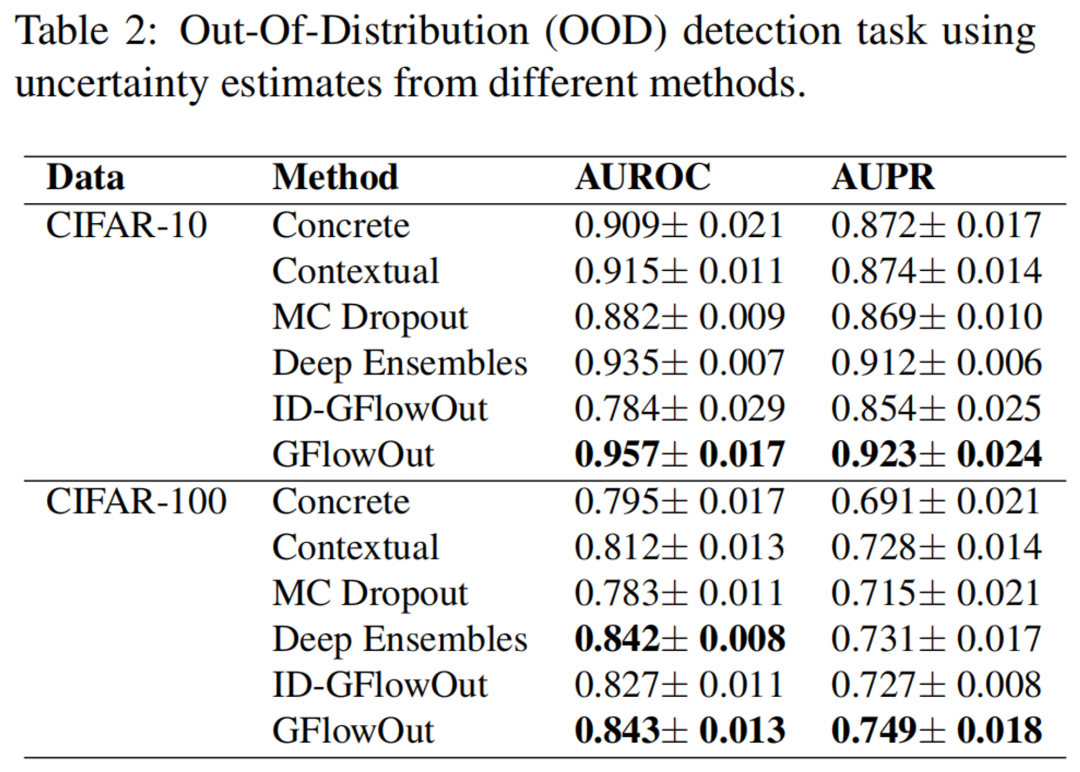

论文题目:GFlowOut: Dropout with Generative Flow Networks 论文链接: https://arxiv.org/abs/2210.12928 作者:Dianbo Liu, …, Yoshua Bengio [Mila – The Quebec AI Institute & NUS, Singapore & DeepMind & Facebook AI Research]

背景:贝叶斯推断作为一种基础工具可以解决现代神经网络的许多关键问题,如校准不良、泛化能力差和数据效率低下。然而,将贝叶斯推断扩展到大型网络架构是具有挑战性的,并且需要限制性的近似。

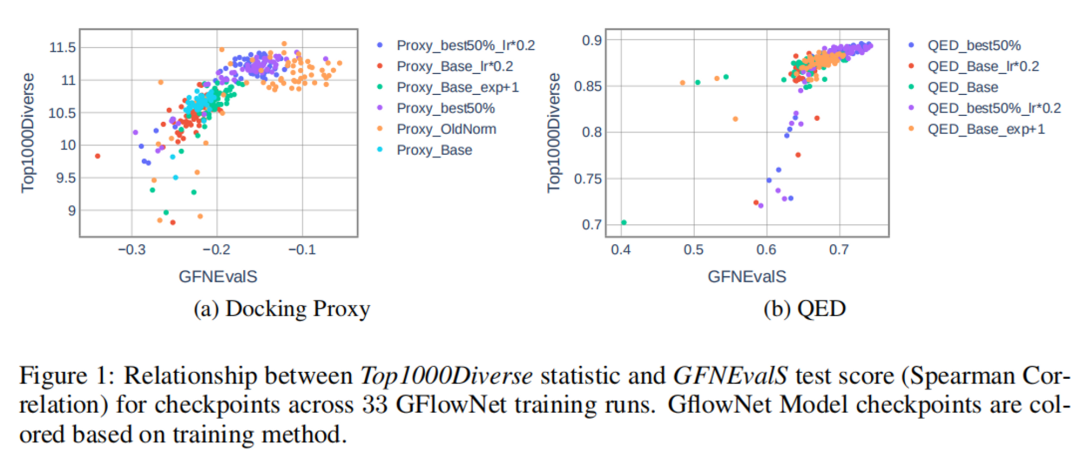

论文题目:Evaluating Generalization in GFlowNets for Molecule Design 论文链接: https://openreview.net/forum?id=JFSaHKNZ35b 作者:Andrei Cristian Nica, Moksh Jain, Emmanuel Bengio, Cheng-Hao Liu, Maksym Korablyov, Michael M. Bronstein, Yoshua Bengio [Mila – The Quebec AI Institute & University of Oxford & Politehnica University of Bucharest]

背景:深度学习对于药物发现问题,如从头设计分子,具有很大的潜力。但是,生成用于训练这类模型的数据是一个昂贵和耗时的过程,因为需要进行实验室实验或昂贵的模拟。这个问题还因为机器学习算法的数据需求量大而加剧。

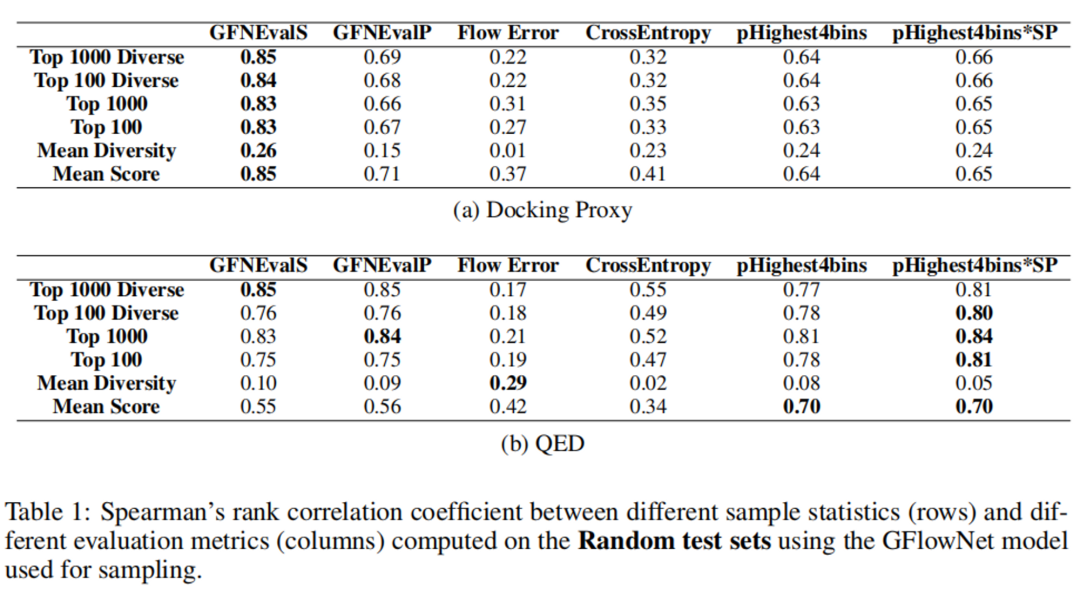

动机:探索如何评估GFlowNet方法在小分子生成中的泛化能力。GFlowNet方法已在生成高得分多样化候选物方面表现出良好的性能,并具有离线非策略方法的优势。然而,为这样的模型找到适当的泛化评估指标,即找到高得分多样化候选物的指标,将有助于指导在线数据收集。因此,本文旨在开发评估GFlowNet性能的技术,并确定最有前途的度量标准以预测泛化。

方法:针对GFlowNet方法的泛化能力评估指标:本文提出了一种名为GFNEval的评估指标,用于跟踪训练和评估GFlowNets的泛化能力。该指标基于生成模型的概率分布和真实数据分布之间的KL散度,可以用于衡量模型在未见过的数据上的性能。

发现:本文使用GFNEval指标来研究GFlowNet方法在训练过程中学习动态。通过对GFNEval值随时间变化的观察,本文发现了一些有趣的现象,例如模型在训练早期会生成较为相似且低得分的分子,而在后期则会生成更多多样化且高得分的分子。这些发现有助于深入理解GFlowNet方法在小分子生成中的工作原理。

结论

结论

资源分享

资源分享

相关信息:Yoshua Bengio. Generative Flow Networks. 2022. 链接: https://yoshuabengio.org/2022/03/05/generative-flow-networks

相关信息:Yoshua Bengio et al. GFlowNets for AI-Driven Scientific Discovery. 链接:https://arxiv.org/abs/2302.00615

相关信息:GitHub – zdhNarsil/Awesome-GFlowNets: A curated list of resources about generative flow networks (GFlowNets). 链接: https://github.com/zdhNarsil/Awesome-GFlowNets

相关信息:GFlowNet Tutorial [PRACTICAL colab notebook] 链接: https://colab.research.google.com/drive/1fUMwgu2OhYpQagpzU5mhe9_Esib3Q2VR

AI+Science 读书会启动

推荐阅读