大模型热潮之后的未来新方向:图神经网络与组合优化 | 文献汇总

导语

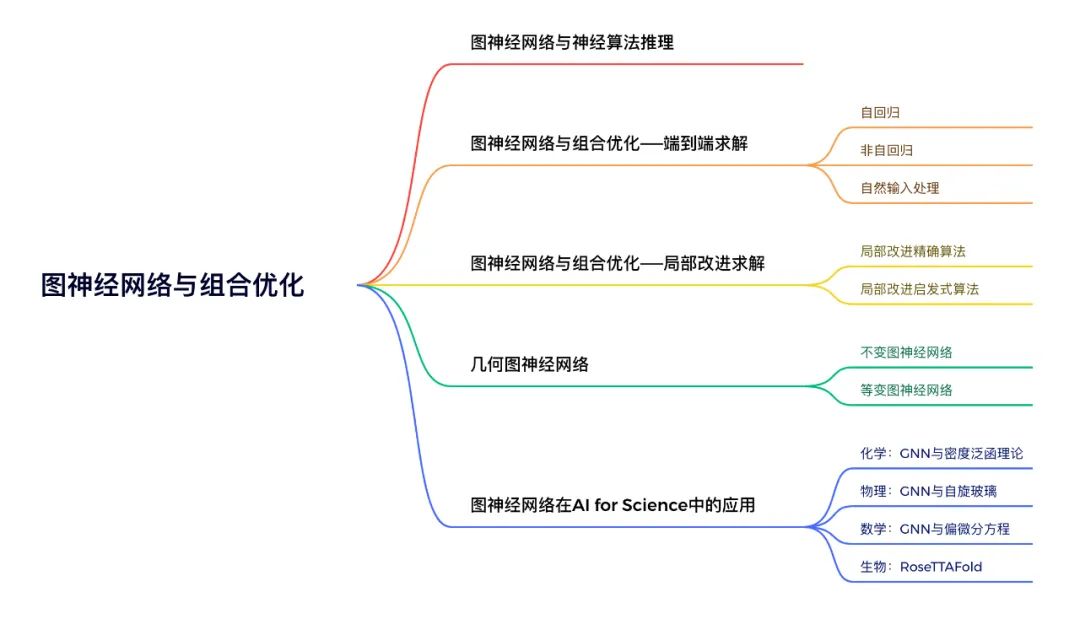

现实世界中大量问题的解决依赖于算法的设计与求解。传统算法由人类专家设计,而随着人工智能技术不断发展,算法自动学习算法的案例日益增多,如以神经网络为代表的的人工智能算法,这是算法神经化求解的缘由。在算法神经化求解方向上,图神经网络是一个强有力的工具,能够充分利用图结构的特性,实现对高复杂度算法的高效近似求解。基于图神经网络的复杂系统优化与控制将会是大模型热潮之后新的未来方向。

为了探讨图神经网络在算法神经化求解的发展与现实应用,集智俱乐部联合国防科技大学系统工程学院副教授范长俊、中国人民大学高瓴人工智能学院助理教授黄文炳,共同发起「图神经网络与组合优化」读书会。读书会将聚焦于图神经网络与算法神经化求解的相关领域,包括神经算法推理、组合优化问题求解、几何图神经网络,以及算法神经化求解在 AI for Science 中的应用等方面,希望为参与者提供一个学术交流平台,激发参与者的学术兴趣,进一步推动相关领域的研究和应用发展。读书会从2023年6月14日开始,每周三晚 19:00-21:00 举行,持续时间预计8周。欢迎感兴趣的朋友报名参与!

读书会框架介绍

读书会框架介绍

读书会文献汇总

读书会文献汇总

主题一:图神经网络与经典算法对齐

-

Veličković P, Blundell C. Neural algorithmic reasoning[J]. Patterns, 2021, 2(7): 100273.

-

Neural Execution of Graph Algorithms. Yiding Feng, Chelsea Finn, and Stefanie Jegelka. NeurIPS 2019.

-

K. Xu, J. Li, M. Zhang, S. S. Du, K.-I. Kawarabayashi, and S. Jegelka. What can neural networks reason about? In International Conference on Learning Representations, 2020b.

-

Deac A I, Veličković P, Milinkovic O, et al. Neural algorithmic reasoners are implicit planners[J]. Advances in Neural Information Processing Systems, 2021, 34: 15529-15542.

-

Ibarz B, Kurin V, Papamakarios G, et al. A generalist neural algorithmic learner[C]. Learning on Graphs Conference. PMLR, 2022: 2: 1-2: 23.

主题二:图神经网络与组合优化——端到端求解

1. 自回归简介

-

Khalil E, Dai H, Zhang Y, et al. Learning combinatorial optimization algorithms over graphs[J]. Advances in neural information processing systems, 2017, 30.

-

Fan C, Zeng L, Sun Y, et al. Finding key players in complex networks through deep reinforcement learning[J]. Nature machine intelligence, 2020, 2(6): 317-324.

-

Bello I, Pham H, Le Q V, et al. Neural combinatorial optimization with reinforcement learning[J]. arXiv preprint arXiv:1611.09940, 2016.

-

Amos B, Kolter J Z. Optnet: Differentiable optimization as a layer in neural networks[C]//International Conference on Machine Learning. PMLR, 2017: 136-145.

-

Kool W, Van Hoof H, Welling M. Attention, learn to solve routing problems![J]. arXiv preprint arXiv:1803.08475, 2018.

2. 非自回归简介

-

Li Z, Chen Q, Koltun V. Combinatorial optimization with graph convolutional networks and guided tree search[J]. Advances in neural information processing systems, 2018, 31.

-

Fu Z H, Qiu K B, Zha H. Generalize a small pre-trained model to arbitrarily large tsp instances[C]//Proceedings of the AAAI Conference on Artificial Intelligence. 2021, 35(8): 7474- 7482.

-

Nazari M, Oroojlooy A, Snyder L, et al. Reinforcement learning for solving the vehicle routing problem[J]. Advances in neural information processing systems, 2018, 31.

-

Chalumeau F, Coulon I, Cappart Q, et al. Seapearl: A constraint programming solver guided by reinforcement learning[C]//Integration of Constraint Programming, Artificial Intelligence, and Operations Research: 18th International Conference, CPAIOR 2021, Vienna, Austria, July 5–8, 2021, Proceedings 18. Springer International Publishing, 2021: 392-409.

-

Pogančić M V, Paulus A, Musil V, et al. Differentiation of blackbox combinatorial solvers[C]//International Conference on Learning Representations. 2020.

主题三:图神经网络与组合优化——局部改进求解

1. 局部改进精确算法

-

Gasse M, Chételat D, Ferroni N, et al. Exact combinatorial optimization with graph convolutional neural networks[J]. Advances in neural information processing systems, 2019, 32.

-

Khalil E, Le Bodic P, Song L, et al. Learning to branch in mixed integer programming[C]. Proceedings of the AAAI Conference on Artificial Intelligence. 2016, 30(1). 这篇论文将图神经网络应用于决策树的分支选择,从而改进了传统的分支策略,从而解决混合 整数规划(MIP)问题。 -

Chen X Y, Tian Y D. Learning to perform local rewriting for combinatorial optimization. In: Proceedings of the 33rd Conference on Neural Information Processing Systems. Vancouver, Canada: Curran Associates, Inc., 2019. 6278−6289

2. 局部改进启发式算法

-

Mills K, Ronagh P, Tamblyn I. Finding the ground state of spin Hamiltonians with reinforcement learning[J]. Nature Machine Intelligence, 2020, 2(9): 509-517.

-

Deudon M, Cournut P, Lacoste A, et al. Learning heuristics for the tsp by policy gradient[C]//Integration of Constraint Programming, Artificial Intelligence, and Operations Research: 15th International Conference, CPAIOR 2018, Delft, The Netherlands, June 26–29, 2018, Proceedings 15. Springer International Publishing, 2018: 170-181.

-

Xin L, Song W, Cao Z, et al. NeuroLKH: Combining deep learning model with Lin- Kernighan-Helsgaun heuristic for solving the traveling salesman problem[J]. Advances in Neural Information Processing Systems, 2021, 34: 7472-7483.

主题四:几何图神经网络

1. 不变图神经网络

-

K. T. Schütt, H. E. Sauceda, P.-J. Kindermans, A. Tkatchenko, and K.-R. Müller. SchNet – A deep learning architecture for molecules and materials. J.Chem.Phys 2018.

-

Johannes Gasteiger, Janek Groß, Stephan Günnemann. Directional Message Passing for Molecular Graphs. ICLR 2020.

-

Johannes Gasteiger, Florian Becker, Stephan Günnemann. GemNet: Universal Directional Graph Neural Networks for Molecules. NeurIPS 2021.

2. 等变图神经网络

-

Nathaniel Thomas, Tess Smidt, Steven Kearnes, Lusann Yang, Li Li, Kai Kohlhoff, Patrick Riley. Tensor field networks: Rotation- and translation-equivariant neural networks for 3D point clouds. 2018.

-

Victor Garcia Satorras, Emiel Hoogeboom, Max Welling. E(n) Equivariant Graph Neural Networks. ICML 2021.

-

Johannes Brandstetter, Rob Hesselink, Elise van der Pol, Erik J Bekkers, Max Welling. Geometric and Physical Quantities Improve E(3) Equivariant Message Passing. ICLR 2022.

主题五:图神经网络在科学计算中的应用

-

数学(GNN与偏微分方程,PDE)

-

物理(GNN与spin glasss)

-

化学

-

生物

相关学习路径

相关学习路径

公众号文章

公众号文章

图网络——悄然兴起的深度学习新浪潮 | AI&Society第八期回顾(总结文章)

图神经网络与组合优化读书会启动