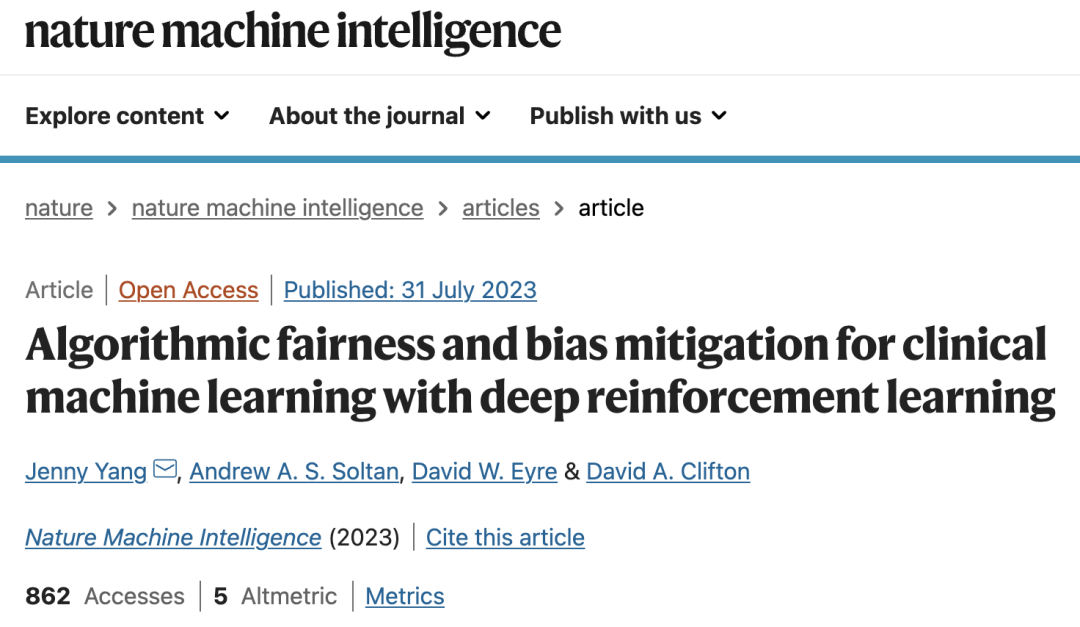

Nat. Mach. Intell. 速递:临床机器学习的算法公平性和减少偏差

关键词:机器学习,强化学习,算法公平性,数据偏差,模型泛化能力

论文题目:Algorithmic fairness and bias mitigation for clinical machine learning with deep reinforcement learning 期刊名称:Nature Machine Intelligence

斑图地址:https://pattern.swarma.org/paper/b9bffc4a-2ff7-11ee-a742-0242ac17000d

论文地址:https://www.nature.com/articles/s42256-023-00697-3

随着基于机器学习的模型不断开发用于医疗应用领域,需要更大的努力来确保这些技术不会反映或加剧数据中可能存在的不良或歧视性偏见。

这项发表于 Nature Machine Intelligence 的最新研究引入了一个强化学习框架,能够减轻数据收集过程中可能产生的偏见。具体而言,对于迅速预测前往医院急诊科的患者是否感染 COVID-19 的任务,研究者对模型做了评估,旨在减轻数据中存在的基于医院和种族的偏见。

通过使用专门的奖励函数和训练过程,表明该方法在实现临床有效的筛查性能的同时,与当前基准和最先进的机器学习方法相比,显著改善了结果的公平性。研究者在三家独立医院进行了外部验证,并在一个患者重症监护病房出院状态任务上测试了该方法,展示了模型的泛化能力。

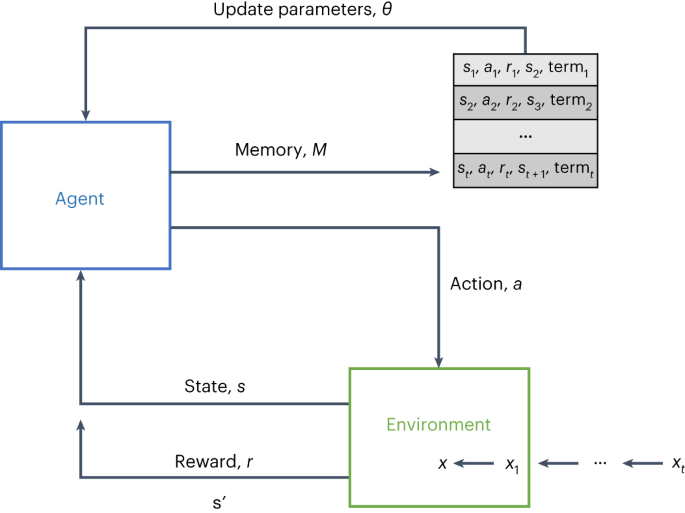

图1. 机器学习框架。

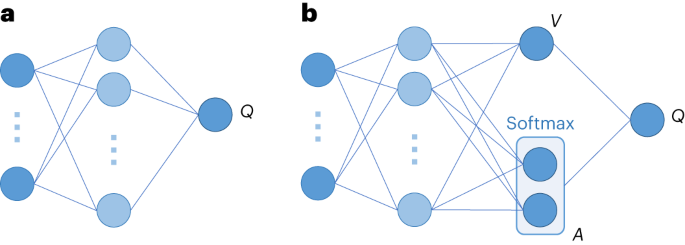

图2. 单流和对抗 Q 网络的比较。

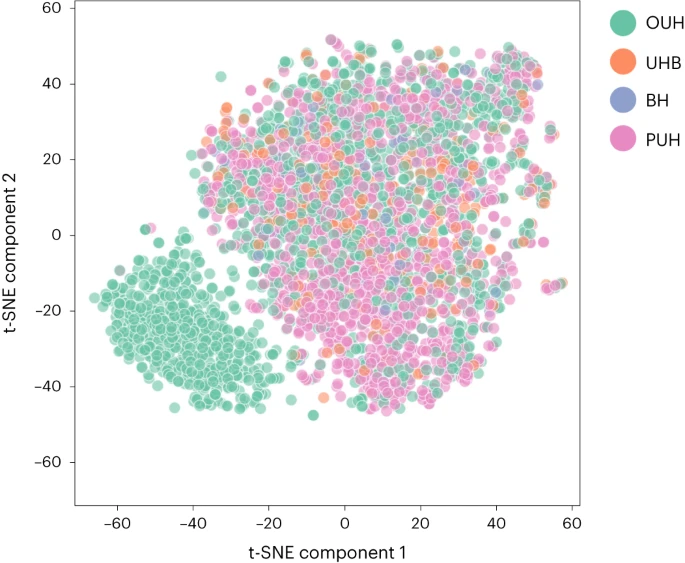

图3. t-SNE 表征。通过 t-SNE 确定的聚类可视化,包含所有 COVID-19 病例。

大模型与生命医学:

AI + Science第二季读书会启动

详情请见:

推荐阅读