关键词:神经可塑性,学习,人工神经网络

Inferring neural activity before plasticity as a foundation for learning beyond backpropagation

论文地址:https://www.nature.com/articles/s41593-023-01514-1

斑图地址:https://pattern.swarma.org/paper/90dc89e8-aadf-11ee-bc79-0242ac17000e

无论对人类还是机器来说,学习的本质都是要找出信息处理管道中的哪些组件应为输出错误负责——这一挑战被称为 “激励分配”(credit assignment)。大脑如何解决激励分配是神经科学的一个关键问题,对人工智能也具有重要意义。长期以来,人们一直认为激励分配最好通过反向传播来解决,这也是现代机器学习的基础。然而,有人质疑大脑是否有可能实现反向传播,而且大脑中的学习实际上可能比反向传播更有效率,效果更优。

发表于 Nature Neuroscience 的这项最新研究提出一种根本不同的激励分配原则,称为前瞻性适配(prospective configuration)。在前瞻性适配中,网络首先推断出学习应该产生的神经活动模式,然后修改突触权重以巩固神经活动的变化。该研究证明了这种不同于反向传播的独特机制:(1) 是皮层电路模型家族中成熟学习的基础;(2) 在生物有机体面临的许多情况下,它能使学习更有效率,效果更优;(3) 重现了在各种人类和动物学习实验中观察到的令人惊讶的神经活动和行为模式。

该发现为超越反向传播的学习奠定了新的基础,有助于理解生物学习和构建人工智能。可用以解释大脑在学习过程中如何调整神经元之间的连接。这一新见解可能会指导大脑网络学习方面的进一步研究,并为人工智能中更快、更强大的学习算法提供灵感。

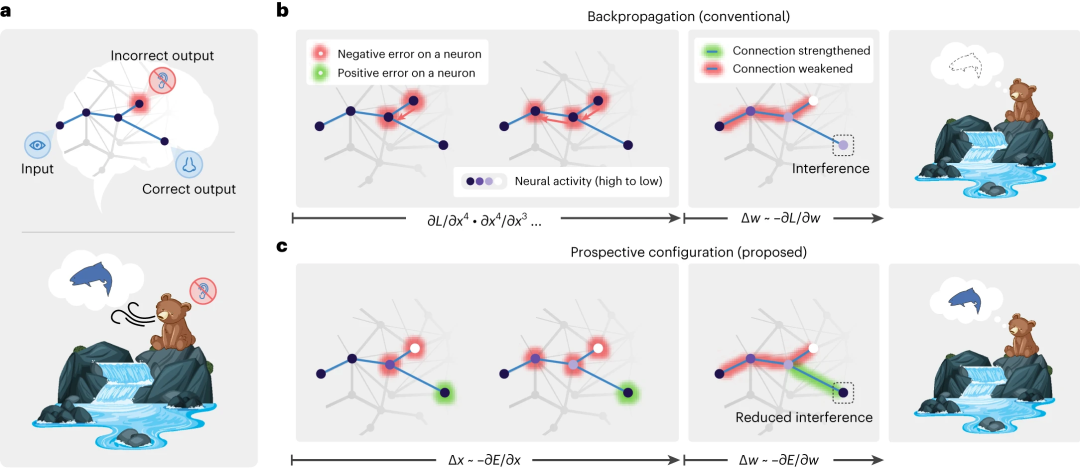

图1:前瞻性适配可避免学习过程中的干扰的例子。a)一个刺激输入(看到水)触发两个预测输出(听到水声和闻到鲑鱼味)。一个输出是正确的(闻到大马哈鱼的味道),而另一个输出则是错误的(没有听到水声)。反向传播在学习过程中会产生干扰:没有听到水声会降低对闻到鲑鱼的预期。听到水声会降低对闻到大马哈鱼的预期。b )尽管大马哈鱼确实被闻到了。另一方面,前瞻性适配则可以避免这种干扰。c)误差从误差输出传播到隐藏神经元(左图)。这会导致一些连接被削弱、这将在下一次试验中改善错误输出,但同时也会降低对正确输出的预测,从而引入干扰(中图和右图)。在前瞻性配置中,神经活动在进入新的配置(不同强度的紫色)之前会稳定下来。该配置对应于学习后应该产生的活动,即 “前瞻性”。因此,它能预见到正确输出上的正误差,并修改连接以改善错误的输出,同时保持正确的输出(中图和右图)。

学习的本质是找出信息处理管道中哪些组件对输出错误负有责任。在人工智能中,这是通过反向传播实现的:调整模型参数以减少输出误差。许多研究人员认为,大脑也采用了类似的学习原理。然而,生物大脑要优于目前的机器学习系统。例如,我们只需看到一次就能学习新信息,而人工系统则需要对相同的信息进行数百次训练才能学会。此外,我们可以在学习新信息的同时保持已有的知识,而在人工神经网络中学习新信息往往会干扰已有的知识并使原有网络迅速退化。

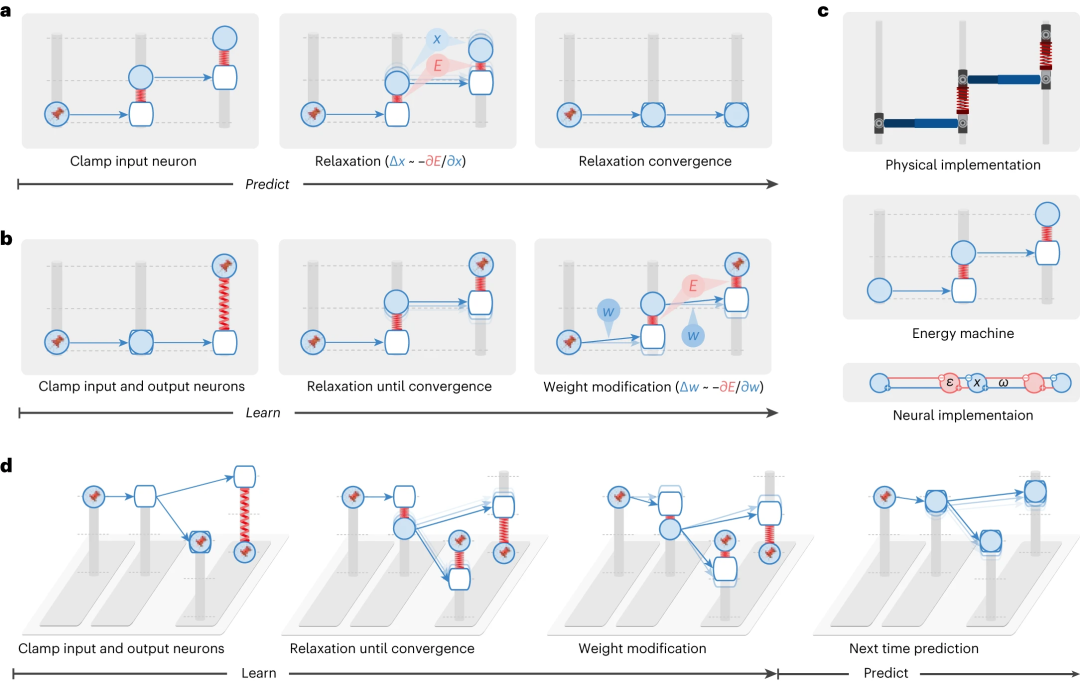

图2:对基于能量的网络、前瞻性配置机制及其理论优势的全新理解及其理论优势。基于能量的网络子集可以可视化为执行等效计算的机械机器。其中之一为预测编码网络。神经元的活动对应于节点(以实心圆圈表示)在柱子上滑动的高度。神经元的输入由同一柱子上的空心节点表示。突触连接相当于一根从实心节点指向空心节点的杆。突触权重取决于突触前神经元的活动,从而影响杆的角度。在基于能量的网络中,松弛(即神经动力学)和权重修正(即权重动力学)都是由能量最小化驱动的,因此分别对应于通过移动节点和调整杆来放松能量机。a-b )基于能量的网络中的预测和学习。这里显示出前瞻性的神经活动,以及之后对权重进行的修改,这种机制被称为前瞻性适配。c ) 预测编码网络的物理实现(顶部)和连通性,编码网络(下图)。d ) 图 1 中的学习问题,通过能量机器可视化,它可以学习改进不正确的输出,同时不干扰正确的输出,这要归功于前瞻性适配机制。

这些观察结果促使研究人员找出大脑在学习过程中使用的基本原理。他们研究了一些描述神经元行为和神经元之间突触连接变化的现有数学方程组。他们对这些信息处理模型进行了分析和模拟,发现这些模型所采用的学习原理与人工神经网络所采用的学习原理根本不同。

在人工神经网络中,外部算法试图修改突触连接以减少误差,而研究人员提出,在调整突触连接之前,人脑首先会将神经元的活动调整为最佳平衡配置,这实际上是人脑学习方式的一个高效特征,因为它通过保留现有知识减少了干扰,从而加快了学习速度。

作者以现实生活中一只熊捕捉鲑鱼为例。这只熊能看到河水,而且它已经知道,如果它还能听到河水的声音并闻到大马哈鱼的气味,它就有可能捕到大马哈鱼。但有一天,熊来到河边时耳朵受损,无法听到河水的声音。在人工神经网络信息处理模型中,听觉的缺失也会导致嗅觉的缺失(因为在学习没有声音时,反向传播会改变多个连接,包括编码河流和大马哈鱼的神经元之间的连接),熊会得出没有大马哈鱼的结论,从而饿肚子。但在动物大脑中,没有声音并不妨碍它们知道还有大马哈鱼的气味,因此大马哈鱼仍有可能在那里等着它们去捕捉。

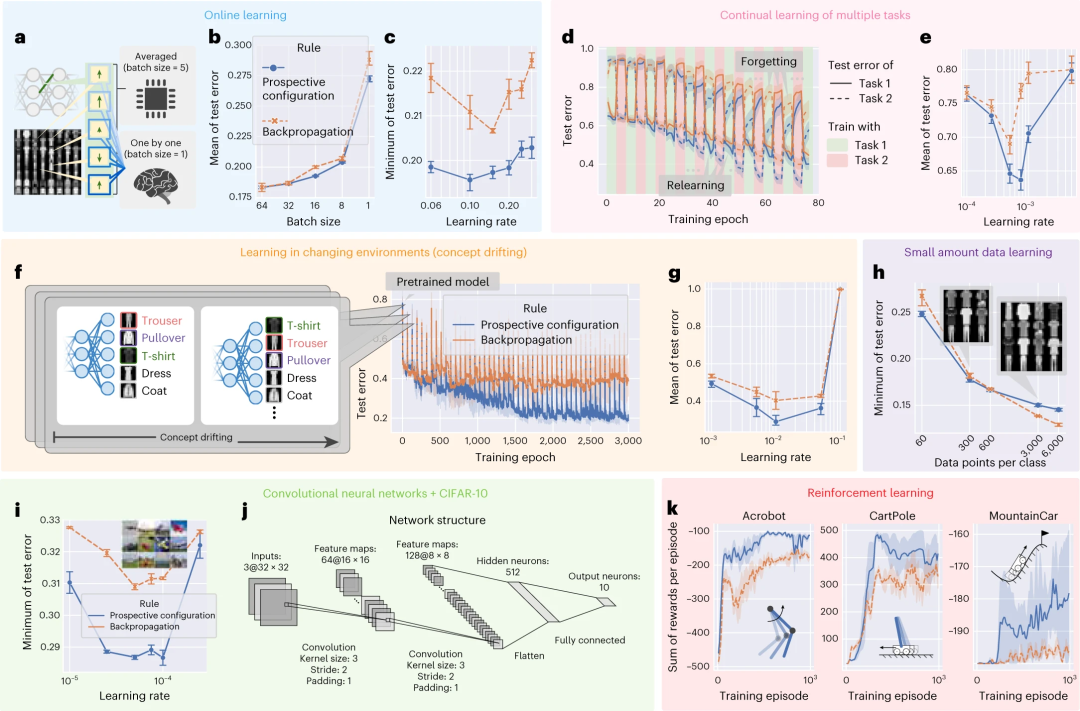

图3:前瞻性适配相比反向传播在多种机器学习任务中的表现更佳

研究人员提出的数学理论表明,让神经元进入前瞻性适配可以减少学习过程中信息之间的干扰。他们证明,前瞻性适配比人工神经网络更能解释多重学习实验中的神经活动和行为。目前,进行前瞻性适配的抽象模型与我们对脑网络解剖的详细了解之间存在很大差距。进一步的研究旨在弥合抽象模型与真实大脑之间的差距,了解前瞻性适配算法是如何在解剖学识别的皮质网络中实现的。就机器学习而言,在现有计算机上模拟前瞻性适配的速度很慢,因为它们的运行方式与生物大脑有本质区别。需要之后开发一种新型计算机或专用的大脑启发硬件,使得能够以较低的能耗快速实现前瞻性适配。

点击“阅读原文”,报名读书会