Nat.Commun.速递:Transformer架构难以学习化学结构的手性识别

关键词:Transformer模型,AI for Science,手性结构识别,字符串表征

论文题目:Difficulty in chirality recognition for Transformer architectures learning chemical structures from string representations 论文期刊:Nature Communications 论文链接:https://www.nature.com/articles/s41467-024-45102-8

近年来,基于多样化分子的表示学习方法,得到了快速发展。典型方法是将自然语言处理(NLP)模型应用于 SMILES(分子结构的文字表示)。然而,关于这些模型如何理解化学结构的研究很少,尤其是在手性识别方面存在固有问题。

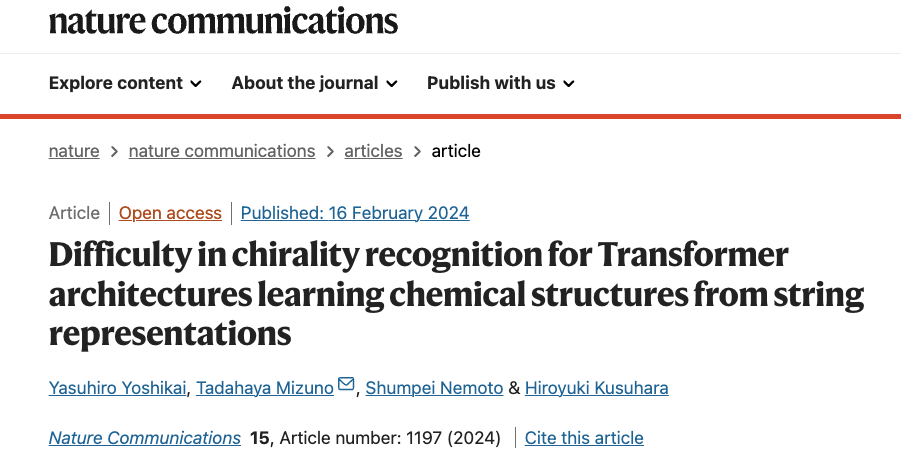

最近发表于Nature Communications的一项研究,通过对Transformer模型学习化学结构的过程进行检查,揭示了这些模型在从字符串表示(如SMILES)学习化学结构时的困难。研究首先训练了一个Transformer模型来翻译SMILES字符串,并在不同训练阶段比较了分子指纹之间的完全一致性和相似性。结果表明,尽管部分结构的识别在训练的早期阶段就已经达到了几乎完全的翻译,但完全准确性的提高却是逐渐发生的。这意味着,Transformer模型在训练的早期阶段就能识别出分子的部分结构,而对整体结构的理解则需要更长时间。

此外,研究还发现,Transformer模型在学习化学结构时,有时会在较低的准确性水平上停滞一段时间,然后突然提高。为了明确这一现象的原因,研究比较了SMILES中每个字符的翻译准确性,并发现了一种方法来防止停滞并稳定学习过程。

这项研究不仅为理解NLP模型如何处理化学数据提供了新的见解,而且还为改进这些模型在化学领域应用的能力提供了可能的方向。

图1 学习过程中Transformer的部分/整体结构识别

AI+Science 读书会

点击“阅读原文”,报名读书会