一作解读:深度学习中的Neural Scaling Law (神经标度律)和对AI+Science的启发

导语

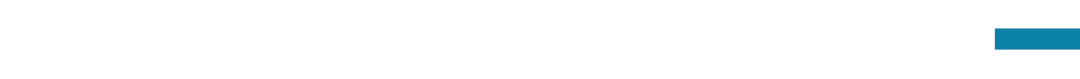

麻省理工大学在读博士刘子鸣同学和他的导师Max Tegmark以及其他成员在Arxiv上发出了他们最新的工作《The Quantization Model of Neural Scaling》,用“知识量子”的想法来解释神经标度律,集智俱乐部邀请了一作作者刘子鸣来重点介绍这篇工作,与此同时刘子鸣同学也发起了一个圆桌讨论,邀请了来自加州大学圣地亚哥分校的助理教授尤亦庄、复旦大学计算机系副教授马兴军、集智科学家,后chatGPT读书会发起人之一李嫣然、斯坦福大学计算机科学系博士后研究员吴泰霖,希望来讨论LLM与Science之间在结合过程中的问题和挑战。本次分享也是集智俱乐部AI+Science读书会与“后chatGPT”读书会的一次梦幻联动,在两个社区会同步分享。

AI+Science 是近年兴起的将人工智能和科学相结合的一种趋势。集智俱乐部联合斯坦福大学计算机科学系博士后研究员吴泰霖(Jure Leskovec 教授指导)、哈佛量子计划研究员扈鸿业、麻省理工学院物理系博士生刘子鸣(Max Tegmark 教授指导),共同发起以“AI+Science”为主题的读书会,从2023年3月26日开始,每周日早上 9:00-11:00 线上举行,持续时间预计10周。欢迎对探索这个激动人心的前沿领域有兴趣的朋友报名参与。

背景介绍

背景介绍

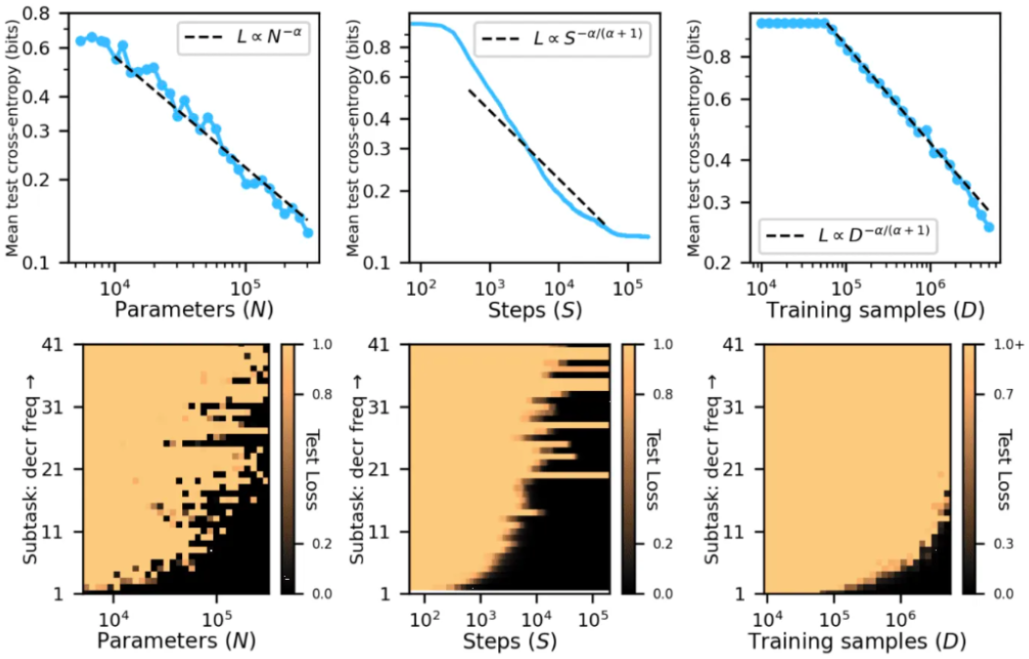

近年来,神经网络由于能够学习复杂模式和做出准确的预测而变得越来越流行。但是,随着神经网络和数据集规模的增加,这些网络的性能往往趋于稳定甚至下降。这种现象被称为神经标度律,它一直是机器学习领域许多研究人员感兴趣的话题。

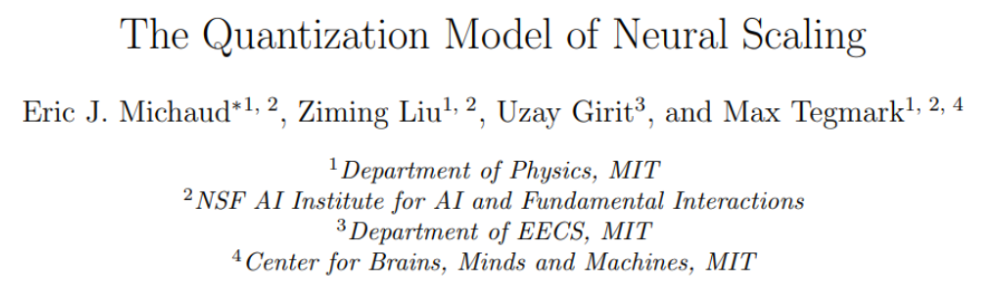

一篇Arxiv的最新文章提出了神经标度律量化模型的理论,并解释了观察到的损失随着模型和数据大小的增加而呈现幂律下降的现象。此外,还探讨了随着模型规模的扩大,新的能力随之涌现的情况。更是详细介绍了深度学习中自然语言模型的训练实践规律。对指导人们设计深度学习模型尤其是自然语言相关的模型有很好的指导作用。通过确定与网络特定功能相对应的量子,研究人员可以优化网络架构和培训过程以提高性能。这可以带来更高效、更有效的神经网络,从而处理更大的数据集和更复杂的任务。

文献地址:https://arxiv.org/abs/2303.13506#

集智俱乐部邀请到了一作之一麻省理工在读博士、AI+Science读书会的发起人之一的刘子鸣来跟大家讨论和解读相关内容。

分享大纲

分享大纲

(1) 标度律简单介绍:

(2) 神经标度律:

(b)离散量子理论

圆桌问题列表

圆桌问题列表

AI被称为“第五范式”(继经验范式、理论范式、模拟范式、数据驱动范式之后)。在你的研究中,AI是否已经改变了研究范式?

在你的研究中,是否更大规模的AI模型会带来更好的效果?“Scale is all you need”有什么局限性?

在你的研究中,AI出现过哪些有趣/奇怪的行为?比如相变,涌现,对Scaling Law的违反等等?

目前的AI大体上是黑盒。如何提高AI for Science的可解释性?你的研究有哪些工具/方法可以被借鉴?

随着更先进的通用人工智能(AGI)出现,如何监管AI以保证结果可信?

以及更多嘉宾和观众的提问,欢迎你提前思考,带着你感兴趣的问题来参与我们的直播(想提问的话,可以扫码加入读书会,获取腾讯会议室会议号即可加入社群噢)。

直播信息

直播信息

直播时间:

2022年4月2日(周日) 上午 10:00-22:00

参与方式

扫码参与读书会,加入群聊获取本系列读书会的视频回放权限、资料权限,与社区的一线科研工作者和企业实践者沟通交流。

主讲人简介

主讲人简介

刘子鸣目前是麻省理工学院(MIT)物理系博士生,导师是Max Tegmark。此前2020年他从北京大学获得物理学士学位。他的研究兴趣在AI和物理的交叉:一方面AI for Physics,利用AI工具自动化物理规律和概念的发现;另一方面Physics for AI,利用物理启发构建AI理论和更具可解释性的模型。

个人主页:https://kindxiaoming.github.io/

参考文献:

https://arxiv.org/abs/2004.10802 “A Neural Scaling Law from the Dimension of the Data Manifold”

https://arxiv.org/abs/2303.13506 “The Quantization Model of Neural Scaling”

https://arxiv.org/abs/2001.08361 “Scaling Laws for Neural Language Models“”

https://arxiv.org/abs/2303.12712 ”Sparks of Artificial General Intelligence: Early experiments with GPT-4”

“后ChatGPT”读书会启动

AI+Science 读书会启动

点击“阅读原文”,报名读书会