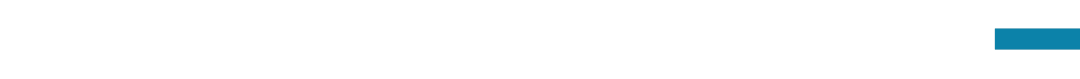

智能是什么?这是人工智能研究的根本性的问题。对“智能”这一概念的不同理解,会将人工智能研究导向迥然不同的方向,同时,对“智能”这一概念的界定也决定了人工智能这一学科的边界,其究竟是属于计算机科学、脑科学、认知科学等,还是自成一体的独立学科。

问答程序“沃森(Watson)”、象棋程序“深蓝(Deep Blue)”、围棋程序“AlphaGo”、聊天机器人“ChatGPT”等的现象级成功都引发了人们的热烈讨论,而其中总是存在正反两方观点,一方认为真正的人工智能已经实现并担忧其取代甚至毁灭人类,另一方认为真正的人工智能并非如此并提出还应当有诸如一二三等等特性。对人工智能的许多问题的讨论,都导向了智能是什么的问题,特别是当问到某物是否实现了真正的人工智能、智能该如何实现、如何度量智能等等,这些问题的答案都取决于“智能”是什么。

人们心中存在着对自己的思维现象的好奇,即对“心(mind)”的好奇,希望探索那个“本质”,尽管在旅途中、做具体的研究时,有时也会迷失方向,“智能”是什么这一问题的答案正是指引我们探索“自己”的“指南针”。

图1. 对“智能”这一概念的不同理解,会将人工智能研究导向迥然不同的方向

在各种复杂的、变化多端的现象下,哪个才是界定“智能”这一概念的关键因素?是否必须要忠实地模拟大脑,或是需要产生与人类相似的行为,还是要解决复杂的问题,亦或是需要具备各种认知功能?这些都有一些合理性,但背后是否有某个在抽象层次上的共同点?人类的大脑、行为、认知过程都体现了适应性,经过适应,人类往往能由简到繁地解决那些未见过的问题[1]。可以说,在各种特点中,适应性才是“智能”的核心特点。

我们当然不能否认经过漫长的演化,形成的大脑结构对“智能”而言的重要性,但模拟大脑时往往被忽略的是,究竟要在多大的精细程度上对大脑做“忠实”的模拟。毕竟,大脑中的许多生理或物理特点对“智能”未必起到关键作用。如果一个模拟大脑的机器,只是在刻板地执行某个程序,而没有适应新环境的能力,这样的机器尽管“类脑”却不符合我们对 “智能”的直觉。

人的行为同样展现出了适应性,特别是那些被称为“学习”的行为。设想,一个不能“学习”的机器,尽管某些方面展现出了像人一样的行为,但总是对相同的输入重复地做着相同的响应,还算是“智能”的吗?例如,对于“计算器”这样的系统,每当输入相同的表达式,输出总是相同且稳定的。当然,也有一些有争议的例子。例如,一个人脸识别的程序,每当看到相同的人脸图像,总是会有相同的分类结果。如果这个人脸识别程序不是从许多“样本”中“学习”得到的,而是一个程序员依靠着一系列的“如果-那么”的语句编写的,说它不是智能的大概就不那么反直觉了。

我们判断一个人“聪明”与否,有时是通过具体的“问题”或“任务”对其进行“测试”。这种测试一定程度上反映了人的“智能”程度,因为通常来说人类生来并未对外部世界有多少经验,那些越能够适应环境的人,经过岁月积累,往往能够展现出高超的能力,这也让我们建立起了“智能”与“解题能力”的“相关性”。然而,“相关不是因果”,在人工智能的研究中,通过“解题能力”来来判定智能的弊端尤其凸显。例如,“计算”曾是人类独有的能力,但是现在计算器的计算能力远远超过了一般人类,大概不会有人认为计算器拥有“智能”。这里的关键在于能力的获取过程,人类解决具体问题上的能力展现常需要一个“适应”的过程,而机器则未必。可以说,这里区分“智能”的因素仍然是“适应性”。

认知科学和人工智能最初有着相似的目标,都包含了对人的心智进行计算建模。人有许多认知功能,常被提及的包括记忆、注意力、感知、推理、规划、决策等,有时判断一个对象是否是智能的,会以是否具有这些认知功能为标准。这种认识对智能的研究有促进的作用,但也有把研究导向支离破碎的风险——将这些认知功能割裂开研究能取得很好的成果,但已有实践表明如何通过“认知架构”整合在一起、使其协同工作却是很大的问题,因为这些功能未必是能够相互割裂的。此外,如果某个机器缺少了适应性,那么即使具备了某些认知功能,也不会被认为拥有了真正的“智能”。例如,早期人工智能的研究已经涵盖了“推理”技术,象棋程序“深蓝”就有很强的“推理” 和“规划”能力,然而,它与人们内心深处所追寻的“真正的”人工智能相去甚远。当然,对此的一种回应是该机器不够“完备”,不具有所有的认知功能。且不论这种“完备”的集合如何界定,我们设想,一个机器或生物体现了对环境的适应能力,即便其不具有某些认知功能(例如“因果推理”),我们是否会认为它是“智能”的?可以说,在具有适应性的基础上,仍然有智能程度高低的问题,而各个认知功能则是为“适应” 环境服务的。

人工智能领域的其中两位奠基人纽厄尔(Newell)和司马贺(Simon)曾提出,概括来说,“智能是有限资源下适应环境的能力”(Newell & Simon, 1976),这几乎十分准确了,只不过在后来他们自己的研究中并没有遵循这一认识。而另一奠基人之一明斯基(Minsky)则认为,概括来说,“智能是解决困难问题的能力”(Minsky, 1988),这种观点看似符合直觉,但正如前面所论证的,一个刻板的计算机程序并不能被认为是“智能”的,尽管它(如“深蓝”)能解决困难问题。虽然明斯基的观点有其合理性,毕竟人工智能最终要走向“应用”,但也具有一些误导性,容易把人工智能研究导向专门问题求解上,一个可能(且现在常见)的结果是人在解决问题而非机器自己,这也是为什么当一个曾经认为重要的问题被“人工智能”解决后,人们仍然会发出种种质疑。对于明斯基的观点的反驳,一个更容易理解的例子是,尽管婴儿没有高超的技能,且基本难以解决困难问题,但大概没有人会否认婴儿拥有“智能”。在图灵1950年的论文(Turing, 1950)中,除了提出了“模仿游戏”(也就是后来广为人知的“图灵测试”)以外,更重要的是在最后一部分,图灵对未来人工智能研究的设想。图灵构思了一个“机器婴儿”,通过后天的“教育”长大成人,进而在智力任务上与人竞争。可以说,机器如何经过“适应”从而成为领域专家,最开始就是一个重要的问题。

当然,“智能”并非“适应性”的同义词,否则我们就不必采用“智能”这个概念,直接说“适应性”就好了。在我看来,“智能”这一概念的定义要从外在和内在两个方面做约束:从外在表现看,“智能”是信息系统利用有限资源适应环境的能力;从内在过程看,“智能”是一种表征相互作用的原理。

“适应”环境意味着,“智能”不是某个特定问题的求解能力,也不是与环境交互过程中获得的技能,而是与获得这些能力或技能的过程有关。系统“适应”环境是指,外部看,在环境相对稳定时、通过某个指标进行评价,系统的表现有向好的趋势,内部看,系统内部状态朝着目标方向发生了改变。“适应”过程中,系统如何改变自身才和“智能”有关,而改变的结果可以说是形成了“技能”。“有限资源”既是一个现实约束,也是一个理论约束,它排除了一些极端情况,例如通过“暴力搜索”的方式解决问题就不是“智能”的研究关心的,因为这种方法理论上假设了无限资源,并用“算法复杂度”来衡量资源的消耗。

这里所谓“表征相互作用的原理”中,所说的“表征”不是主体内部的、对外部物体的指称物,而是指人工智能研究中的“知识表示”的具体内容,像是“专家系统(Expert System)”中的“符号”、“深度学习(Deep Learning)”中的“向量”、“类脑计算(Neuromorphic Computing)”中的“脉冲(Spikes)”等。这里所说的原理是对智能现象背后的机制的抽象描述,而“表征”则是用来描述原理的基本单元。在“适应性”这一大前提下,我们可以探讨相关的原理有哪些。对这一原理集的探索和描述有不同的切入点,例如,研究脑的结构、研究某些问题的求解过程、研究人的行为、研究认知功能,不论是从哪个角度,尽管可能会得到不同形式的描述,但最终都要进行总结和抽象,找到那个最一般的、与生物或计算机实现细节不直接相关的原理。这一原理的集合并非在本文中能够详细讨论和给出,它随着“智能”的研究深入而发展, “智能”这一概念的含义也因此会逐渐变化。

这种“智能”的解释可以适用于“机器学习(Machine Learning)”,毕竟“学习”就是适应的过程。但似乎不是所有的有限资源下的适应性都是人们内心深处的“智能”那物,特别是对于典型的“机器学习”系统。“机器学习”系统的确能工作在有限的资源下,毕竟这是一个现实约束,同时,人们也发现了,一个“机器学习”系统往往只能解决少数一些问题[2],而没有人类智能那样的“通用性”。例如“AlphaGo”高超的围棋技能正是它的“智能”发挥作用后的结果,但“AlphaGo”及其继任者(如“Alpha Zero”)仅仅在某一类问题(例如围棋、象棋、Dota等)上表现得很好,却不具有人类这样的“通才”,不能适应广泛的场景[3]。一批研究者最早在2006年(AGI Workshop上)正式提出了“通用人工智能(Artificial General Intelligence, AGI)”的概念(Wang & Goertzel, 2007),与特定问题求解系统的“人工智能”研究划清了界限。尽管如此,我们并不能否认“机器学习”系统体现了“智能”。那么,“机器学习”中导致争议的是什么?

一个典型的机器学习系统包含三个部分:“学习算法”、“数据”、“技能程序”(也被称为“模型”),并通常将学习过程分为训练和测试两个阶段。在训练阶段,“学习算法”通过总结数据中的经验,调整“技能程序”。测试阶段,“技能程序”根据输入做出响应,从而“解决问题”。我们可以发现,“机器学习”将以往由人类开发者编写的“技能程序”交由“学习算法”从数据中总结,机器在这一过程中尝试通过适应环境(即数据)来解决问题。然而,在测试阶段,“学习算法”已经不再起作用了,也就是说,此时机器不再具有适应性,而是仅仅执行“技能程序”,“刻板地”响应输入信号。这也是为什么它不再符合人们直觉上的“智能”了。许多机器学习的研究者也意识到了这一点,提出“连续学习(Continuous Learning)”、“终身学习(Life-long Learning)”等的概念和方法正是摆脱这一困境的努力。

在我看来,“通用智能”是“利用有限资源适应开放环境的能力”[4],相较之前这里增加了一个限定条件,即“开放环境”。所谓“开放环境”是一个相对概念,因为如果在整个宇宙的尺度下看,所有物质都处在宇宙这个“封闭环境”中(这里暂不考虑平行宇宙等情况)。然而,相对于一个主体而言,在其生命周期内,其活动在一个相对有限的范围内,而该范围外的情况对于该主体而言是“未知”的。其后果是,该主体所面对的环境可能发生变化(甚至是根本性的变化),未来未必与过去经验一致、主体过去认识到的规律可能被推翻。同时,“开放环境”的另一层含义是对适应的对象所做的约束,该对象排除了特定某个或某类问题这样的“封闭环境”,并认为对具体问题而言没有明确预先定义的边界。在有限的资源下,面对开放的环境,智能体的知识和资源都是不足的[5]。这种对“智能”的解释兼顾了当下的主要研究(机器学习),也可扩展至未来研究(通用人工智能)。在对“智能”的解释的基础上,这种对“通用智能”的解释既兼顾了主体的特性(应对环境的改变),又明确了适应对象的边界(非特定问题)。

除了从外在的视角看,同前面对“智能”的解释一样,“通用智能”继承了其内在的视角,即“表征相互作用的原理”。对于“通用智能”而言,这些原理是否存在某个最小完备集合?例如,有些工作认为这一集合中必须包含系统的“实时性”相关的原理,有些工作认为必须包含“感知”相关的原理,有些看法把“因果推理”放在该原理集中的至关重要的位置。我相信这在目前仍是开放的问题,也是“通用智能”研究的重点。在前述对“智能”的“内在”约束中,我猜想“原理集”的完备程度或许就确定了智能的程度高低,而某些“专用智能”系统或许缺少了完备的“原理集”中的某些部分。

“通用智能”的对立面是“专用智能”。“专用智能”并非特定问题求解的“技能”,因为按照本文中的观点,它连“智能”都算不上。在我看来,“专用智能”系统缺乏对“开放环境”的处理能力,仅仅对特定问题或领域展现出适应性。例如,一个用神经网络识别手写数字的系统,它对输入和输出的形式的规定导致了它只对手写数字的问题有效;另一个例子是,人有时会基于过往经验总结自己的“学习方法”,而这些“学习方法”适用于多个场景(例如不同学科),遵照一个“学习方法”同样能够习得具体的知识和行为,但该“学习方法”总有一定的适用范围,例如学习语文的方法就不完全适用于学习数学。相反,“通用智能”系统是“领域无关”的。例如,同样是基于神经网络,“Gato”(Reed, et al, 2022)则可以看作一个“通用智能”系统(尽管程度不高);再比如,领域相关的“学习方法”本身就有一个习得的过程,这一习得过程所依赖的是“通用智能”。

即便一个系统满足了上述“通用智能”的定义,能够利用有限资源适应开放环境,这也不意味着“通用人工智能”的研究就此完成了。相反,我认为这常是“通用人工智能”研究的“开始”,因为“通用智能”也有程度问题。触到了智能问题的核心后,困难和有趣的地方是对上述智能原理的探索。说“通用人工智能”已经实现,或“通用人工智能”遥遥无期,两种说法虽然极端,但都体现了对实现那个原理上完备的“通用人工智能”系统的期望。至于智能科学的大厦何时建成、“通用人工智能”何时实现,就要看我们几代人的努力了。从现有工作来看,前人已经为我们指明了方向、做好了地基和框架。

按照前面对“智能”和“机器学习”的讨论,“典型的”机器学习方法在测试阶段已经谈论不上“智能”了,但现代的方法中有例外需要额外讨论。

ChatGPT在“测试”阶段展现出的“灵活性”让许多人惊讶,这也引发了对“适应”这一概念含义的进一步考虑。大概不会有人否认训练阶段ChatGPT体现了适应性(由于神经网络权重的修改)。那么,在测试阶段ChatGPT进行了任何“适应”吗?一方认为,每轮新的对话中ChatGPT的状态都被重置,对于每轮对话而言其表现并没有根本的变化,因此没有发生适应。另一方认为,ChatGPT 的“语境内学习(In-Context Learning)”是适应的体现。

为了讨论更具体,让我们考虑这样一种情况:一个基于概率的统计学习算法,在没有任何条件时,输出是P(X),当增加了条件A后,输出是P(X|A),进一步增加条件B后,其输出是P(X|A,B),且在某个评价指标下,系统的表现逐步变好。这个例子中,变化的是新增的条件,而不变的则是概率分布。每当重新输入各个条件后,一个系统如果发生了“适应”,我们会发现第二次的P(X|A,B)的表现应当优于第一次的P(X|A,B)的表现,若是相反,则系统并未发生“适应”(Wang, 2004)。

若将“提示词(Prompts)”类比于上面的条件A、B,那么ChatGPT正是属于后者的情况,从ChatGPT的整个生命周期来看(从它诞生的那一刻开始“训练”,经过现在的“测试”,直到未来被停止运行),以某一个“对话”作为“任务”,那么每个任务上的表现没有根本的变化,即并未发生“适应”——换句话说,从这个大尺度看,“适应”仍是发生在训练阶段,而用于实现ChatGPT的“Transformer”的结构、神经网络的误差反向传播等才是和“智能”直接相关的。

但从一个更小的尺度看,将一轮“对话”看作ChatGPT系统的“生命周期”,每一次提问看作一个“任务”,那么,面对依次的输入A、B,系统的表现发生了变化,特别是再次输入A后可以观察到表现的提升(例如,对纠正错误回答后再次进行提问)。在这一观点下,ChatGPT“训练”后得到的“权重”不是严格意义上的前述概率分布P,而是习得了某种“适应程序”,在不改变权重的前提下,运行该“适应程序”P,系统产生了“适应”的表现。

双方都是对的,只不过观察的尺度不同。但是,设想,如果将训练好的ChatGPT(其模型参数不再变了)放在某个人类的语言经验或视觉经验没有触及的地方(例如另一个星球或者另一个物理规律完全不同的宇宙,或是给它一个动物或机器人的身体),那么它会体现“适应性”吗?可以说,此时那些习得的“适应程序”不再适用了。按照本文中对“智能”这一概念的解释,两种视角都看到了ChatGPT的“智能”,但其含义不同。从前者看到的是“通用智能”,即对“开放环境”的适应性(ChatGPT仍然可以通过梯度下降学习来适应新环境),而从后者看到的是“专用智能”,即对一定领域范围内的适应性(不含盖超出人类语言经验的范围)。

我们会发现,目前的人工智能研究涵盖了前面提到的各个概念,图2概括了它们之间的关系。“人类智能”从大自然的演化中诞生,我们尝试观察“自己”,特别是自己的思维规律,尝试总结出一套认识和改造世界的基本原理,并用机器(特别是“计算机”)进行实现,所实现的对象(主体)常被称为“智能体(Intelligent Agent,或Agent)”。“智能体”利用自己的“智能”总结经验和解决问题,其中变化的是解决具体问题的技能,而获得技能的方法则相对稳定。如果“习得技能的方法”也可以被习得,那么习得“习得技能的方法”的又是什么?智能体总要在某个层次上“被预设”、“保持不变”,本文将这个层次上的对象称为“通用智能”,而智能体的经验经过“智能”的处理(即“表征相互作用”)则形成了用于解决问题的“技能”。其中,“习得技能的方法”也可从经验中被总结出来,只不过这里习得的“(有适应性的)技能”的适用范围与任务相关,因此在本文中它们被称为“专用智能”。

早期的人工智能研究,许多关注于用计算机解决问题,相关的计算机程序缺乏适应性,是本文中所说的“技能”;人们为特定问题设计的适应性方法,往往掺入了开发者对特定问题的经验,这些问题特定的经验不适用于“开放环境”,导致了“适应”的问题范围往往十分局限,但这些方法从应用角度来讲也十分有价值。同时,也有一些工作聚焦于与具体问题无关的原理,即“通用智能”,其旨在探索发生在人类、动物、群体、甚至可能存在的“外星人”等等的“心智”中的、复杂现象背后的、认识和改造世界的基本原理,这套原理的计算机实现被称为“通用人工智能”[6]。“通用智能”是否能由人工演化过程得来?是可能的,但演化中的适应性与人类身上的“通用智能”有着根本性的区别[7],由于篇幅限制,此处就不展开了。

当然,“通用”也是相对的,毕竟,我们(人类)对自身“心智”的建模也难以避免地受到了自己经验的影响,即其适用范围受到了“我们对所生活世界的经验”的影响,我们总结出的“通用智能”是否是放之宇宙而皆准,这是超出我们经验范围的问题了,但至少“通用人工智能”的工作在朝着这个方向努力、尽可能减少特定问题经验的影响。

图2. 本文中的概念关系

当前,有人认为只要能够解决问题、或是具有某些“认知”功能,即使没有适应性,也算是“智能”,这是本文明确反对的立场。在“适应性”这一大前提下,对有些人而言,“专用智能”就是“智能”,并且已经足够应用了;而对有些人而言,“通用智能”才是所追求的最终目标、“智能”就是指“通用智能”。或许,在未来“真正的”人工智能实现以后,大众观念大概会偏向于后者。不论怎样,按照前面的论述,我们对“智能”本身已经有了认识。可以说,“(通用)智能”是那个“生来就有”的、不随后天经验而改变的某物[8],而“智能”通过后天与环境交互形成的“技能”则是易变的,随着“经验”的不同而不同、对特定问题有效。“通用人工智能”研究所追寻的,正是对“通用智能”的计算机实现,而非具体一个或一类问题的解决方案。

正如《金刚经》中所言:“一切有为法,如梦幻泡影,如露亦如电”。那个“不变”的“本来面目”究竟是什么样?随着“通用智能”研究深入,或许这一问题将逐渐会有答案。

致谢

感谢在完成此文章过程中参与讨论、提出意见、审阅和编辑的朋友。

参考资料

Minsky, M. (1988). Society Of Mind. Simon and Schuster.

Newell, A., & Simon, H. A. (1976). Computer Science as Empirical Inquiry: Symbols and Search. Communications of the ACM, 19, 113–126.

Turing, A. M. (1950). Computing Machinery and Intelligence. Mind, LIX(236), 433–460. https://doi.org/10.1093/mind/LIX.236.433

Wang, P. (2004). The limitation of Bayesianism. Artificial Intelligence, 158(1), 97–106. https://doi.org/10.1016/j.artint.2003.09.003

Wang, P. (2018). On Defining Artificial Intelligence. Journal of Artificial General Intelligence, 10(2), 1–37. https://doi.org/10.2478/jagi-2019-0002

Wang, P., & Goertzel, B. (2007). Introduction: Aspects of Artificial General Intelligence. Proceedings of the 2007 Conference on Advances in Artificial General Intelligence: Concepts, Architectures and Algorithms: Proceedings of the AGI Workshop 2006, 1–16.

王培. (2022). 智能论纲要. 上海科技教育出版社有限公司.

Reed, S., Zolna, K., Parisotto, E., Colmenarejo, S. G., Novikov, A., Barth-maron, G., Giménez, M., Sulsky, Y., Kay, J., Springenberg, J. T., Eccles, T., Bruce, J., Razavi, A., Edwards, A., Heess, N., Chen, Y., Hadsell, R., Vinyals, O., Bordbar, M., & Freitas, N. de. (2022). A Generalist Agent. Transactions on Machine Learning Research.

注释

[1] “人类智能”有不同的抽象层次,包含“结构”、“行为”、“(问题求解)能力”、“(认知)功能”、“原则”(Wang, 2018)。下面基本按照这个框架进行论述。

[2] 这里所说的是机器学习“系统”而非“算法”。一个数学方法或算法是通用的,与一个系统是通用的,二者含义不同。“人”这一智能“系统”的通用性属于后者。

[3] 并非说这些工作没有价值,例如,强化学习的总体框架是对的,只不过在具体细节上需要进一步考虑。

[4] 此处的“通用智能”是在人工智能的语境下讨论的,但注意同一个词在不同语境下有不同的含义。例如,在心理学中的“通用智能”就是另外的含义了,尽管二者有着在直觉上的相似性。这两个含义的相似与差别在(Wang & Goertzel, 2007)中也有类似的说明。

[5] 因此,这里对“通用智能”的定义与(Wang, 2018)中对“智能” 的定义(即“智能是信息系统在知识与资源不足时适应环境的能力”)大体等价,尽管略有不同。也可参考在《智能论纲要》(王培,著)中对智能的描述,其中的智能本身就是领域无关的、通用的,说“专用智能”就太奇怪了。

[6] 这里是对“通用人工智能”的非正式描述,而非正式定义。

[7] 参见《智能论纲要》。图 1 中,括号中的概念与该书中的用法或许更贴近。

[8] 尽管某些“生来就有”的也会随着后天经验而改变,也并非所有“生来就有”的都属于智能。例如动物身体的本能反应等。

感兴趣的朋友可以扫描下方二维码,观看读书会视频回放

斑图地址:https://pattern.swarma.org/study_group_issue/525

徐博文,美国天普大学PhD在读,研究方向为通用人工智能(AGI),致力于探索通用智能的理论并创造“真正的”人工智能。

个人主页:http://www.xubowen.site/

为了深入探讨 AGI 相关话题,集智俱乐部联合集萃深度感知技术研究所所长岳玉涛、麻省理工学院博士沈马成、天普大学博士生徐博文,共同发起 AGI 读书会,涵盖主题包括:智能的定义与度量、智能的原理、大语言模型与信息世界的智能、感知与具身智能、多视角下的人工智能、对齐技术与AGI安全性、AGI时代的未来社会。读书会从2023年9月21日开始,每周四晚上 19:00-21:00,预计持续7-10周。欢迎感兴趣的朋友报名参与!

详情请见:

AGI 读书会启动:迈向通用人工智能的跨学科路径