Yes, We KAN! MLP out!一作刘子鸣直播解读全新神经网络框架KAN

摘要

论文速递:Yes, We KAN!

论文速递:Yes, We KAN!

论文题目:KAN: Kolmogorov–Arnold Networks

论文地址:https://arxiv.org/html/2404.19756v1

1900年,在国际数学家大会的巴黎演讲中,希尔伯特(David Hilbert)曾提出了23个对数学发展至关重要的问题。Kolmogorov-Arnold表示定理正与其中的希尔伯特第13问题密切相关。该定理指出,如果f是任意一个定义在有界域上的多变量连续函数,则该函数可以表示为有限数量的单变量、连续函数的两层嵌套叠加的形式。

这表明真正的多元函数是一种求和,所有多元函数都可以通过对单变量函数求和的方式得到。从神经网络作函数拟合的角度看,这意味着对任一高维多变量函数的学习最终都可以被归约为对一组单变量函数的学习。

受到Kolmogorov-Arnold表示定理的启发,研究成员期望参数化Kolmogorov-Arnold表示,将该想法显式嵌入神经网络的设计之中。他们提出KANs(Kolmogorov-Arnold Networks, KANs)作为传统多层感知机(Multi-layer perceptrons, MLPs)的有力竞争模型。相较于传统的MLPs在节点(神经元)上使用固定的激活函数,KANs在边(权重)上采用可学习的激活函数。

基于Kolmogorov-Arnold表示定理的基本思想,KANs网络中创新性采用B样条曲线来参数化表示定理中的每个单变量函数。其中B样条是一种局部、分段的多项式曲线,其系数是可学习的。为了将网络推广到任意宽度和深度,而非局限于内、外部函数对应的两层非线性层和一个隐藏层,研究人员进一步提出了更一般的定理版本作为模型构建的理论指导。同时,受MLPs层叠设计的启发,通过堆叠带有可学习参数的一维函数矩阵构成的KAN层,拓展了KANs模型的深度,同时保持了网络较好的可解释性和表达能力。

研究通过丰富的实验设计证明了KANs模型的优越性。结果显示,KANs相比传统的MLPs拥有更好的参数效率、更强的表达能力,独到的模型设计显著增强了实验结果的准确性,使注入领域知识和归纳偏置变得容易,加上符号公式的组合构建能力和交互性设计使可解释验证得以做到,由此进一步增强了模型的可解释性。值得一提的是,研究针对KANs在数据量和模型参数量层面的神经标度率(scaling law)进行了详尽的讨论。在五个玩具案例中,KANs比MLPs有着更快的标度变化速度。在求解偏微分方程任务中,KANs也展现出更快的收敛速度、达到更低的损失,并有着更陡峭的标度率表现。

在拟合特殊函数任务中,KANs在所有特殊函数对比中展现出比MLPs更好的帕累托前沿(Pareto Frontier)。而且,借助样条设计的局部性天然优势,KANs可以在新数据上实现持续学习(continue learning),规避了机器学习中存在的灾难性遗忘(catastrophic forgetting)问题。此外,令人震惊的是,研究人员使用仅有200参数量的KANs就成功复现了Deepmind在《Nature》杂志上发表的基于30万参数量MLPs发现扭结理论(knot theory)数学定律的研究工作。并且KANs能发现与代数和几何扭结不变量相关的全新关系,同时给出一定的解释,而无需像MLPs一样进行特征归因的后期分析。在物理研究方面,KANs在凝聚态物理中的一种相变——Anderson局域化的问题上展现出了出色的相变边界发现能力,说明了该模型在物理研究领域也具备强大的应用潜力。

这项研究为未来可解释模型设计开辟了新的思路,并为我们展示了KANs模型广阔的应用前景。有了KANs的支持,对于科学工作者而言,快速、准确地发现大量科学数据中新的规律和趋势将变得更加容易。其强大的符号公式组合构建能力、可视化功能和优秀的交互性设计也有助于揭示”黑盒”数据处理流程的真相,增加实验结果的可解释性。因此,KANs无疑将成为赋能Science研究的重要AI工具,并推动科学研究加速向AI+Science范式进行转变。更多的潜在研究价值和应用的可能性有待进一步探索和挖掘。

一作直播解读:

KAN: Kolmogorov-Arnold Networks

一作直播解读:

KAN: Kolmogorov-Arnold Networks

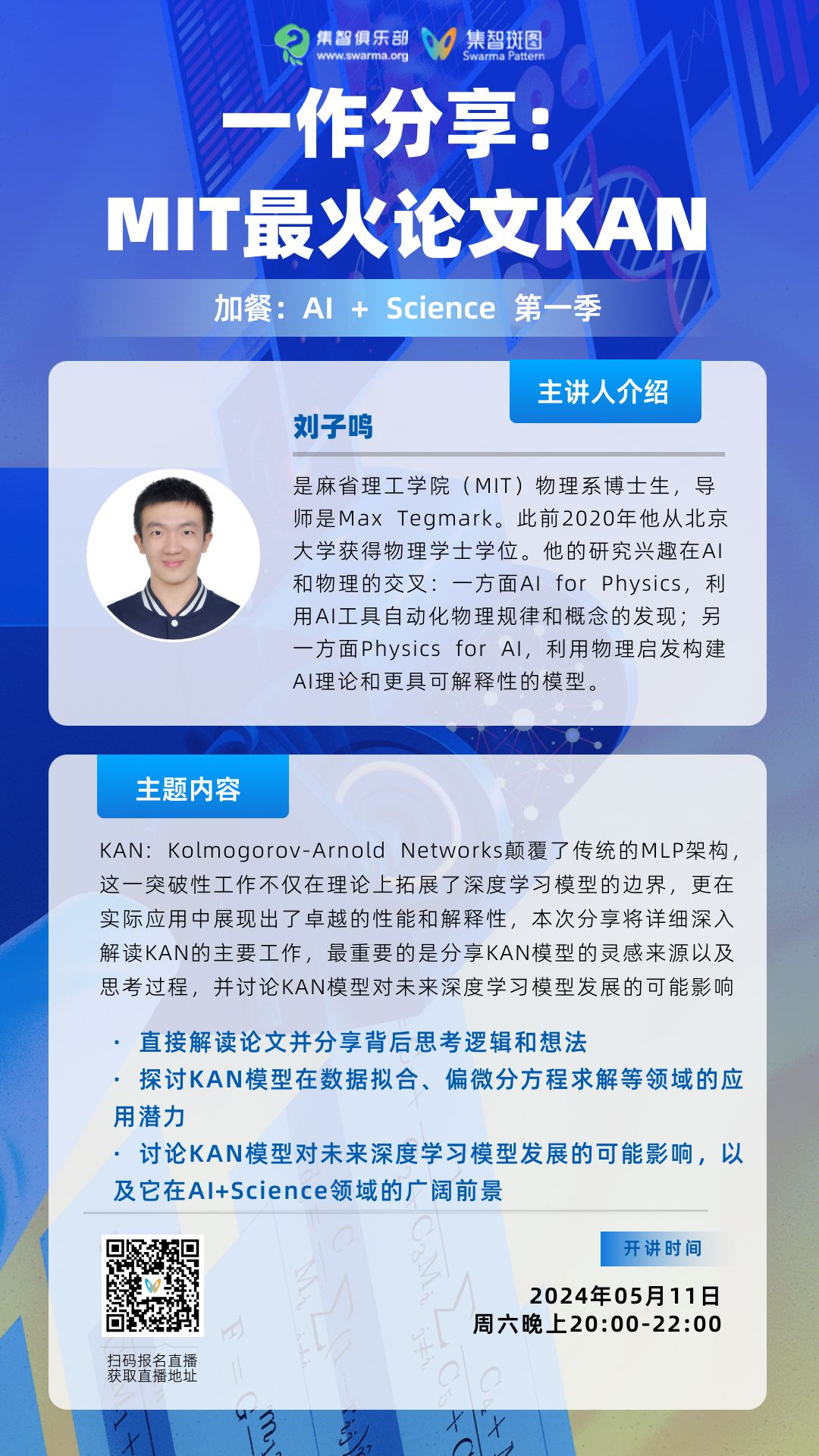

主讲人简介:

分享大纲:

-

论文深度解读 -

论文一作解读:刘子鸣博士将直接根据论文原文,逐章深入讲解KAN的理论基础、模型架构和实验结果。 -

背后的思考逻辑和想法:分享KAN模型的灵感来源,以及如何从Kolmogorov-Arnold表示定理中汲取思想,构建出具有强大表达能力和解释性的神经网络。 -

衍生研究方向 -

探讨KAN模型在数据拟合、偏微分方程求解等领域的应用潜力。 -

讨论KAN模型对未来深度学习模型发展的可能影响,以及它在AI+Science领域的广阔前景。

参与方式:

直播时间:

参考资料

Ziming Liu, Yixuan Wang, Sachin Vaidya, et al. KAN: Kolmogorov-Arnold Networks. arXiv:2404.19756, 2024

Paper: https://arxiv.org/abs/2404.19756

Github: https://github.com/KindXiaoming/pykan

Documentation: https://kindxiaoming.github.io/pykan/

AI+Science 读书会

人工智能与数学读书会

数十年来,人工智能的理论发展和技术实践一直与科学探索相伴而生,尤其在以大模型为代表的人工智能技术应用集中爆发的当下,人工智能正在加速物理、化学、生物等基础科学的革新,而这些学科也在反过来启发人工智能技术创新。在此过程中,数学作为兼具理论属性与工具属性的重要基础学科,与人工智能关系甚密,相辅相成。一方面,人工智能在解决数学领域的诸多工程问题、理论问题乃至圣杯难题上屡创记录。另一方面,数学持续为人工智能构筑理论基石并拓展其未来空间。这两个关键领域的交叉融合,正在揭开下个时代的科学之幕。

为了探索数学与人工智能深度融合的可能性,集智俱乐部联合同济大学特聘研究员陈小杨、清华大学交叉信息学院助理教授袁洋、南洋理工大学副教授夏克林三位老师,共同发起“人工智能与数学”读书会,希望从 AI for Math,Math for AI 两个方面深入探讨人工智能与数学的密切联系。读书会已完结,现在报名可加入社群并解锁回放视频权限。

详情请见:

人工智能与数学读书会启动:AI for Math,Math for AI