LLM-as-Agent:大模型赋能时空智能体 | 周三直播·时序时空大模型读书会

导语

研究领域:时空智能体,具身智能,城市交通,信任博弈

分享内容简介

分享内容简介

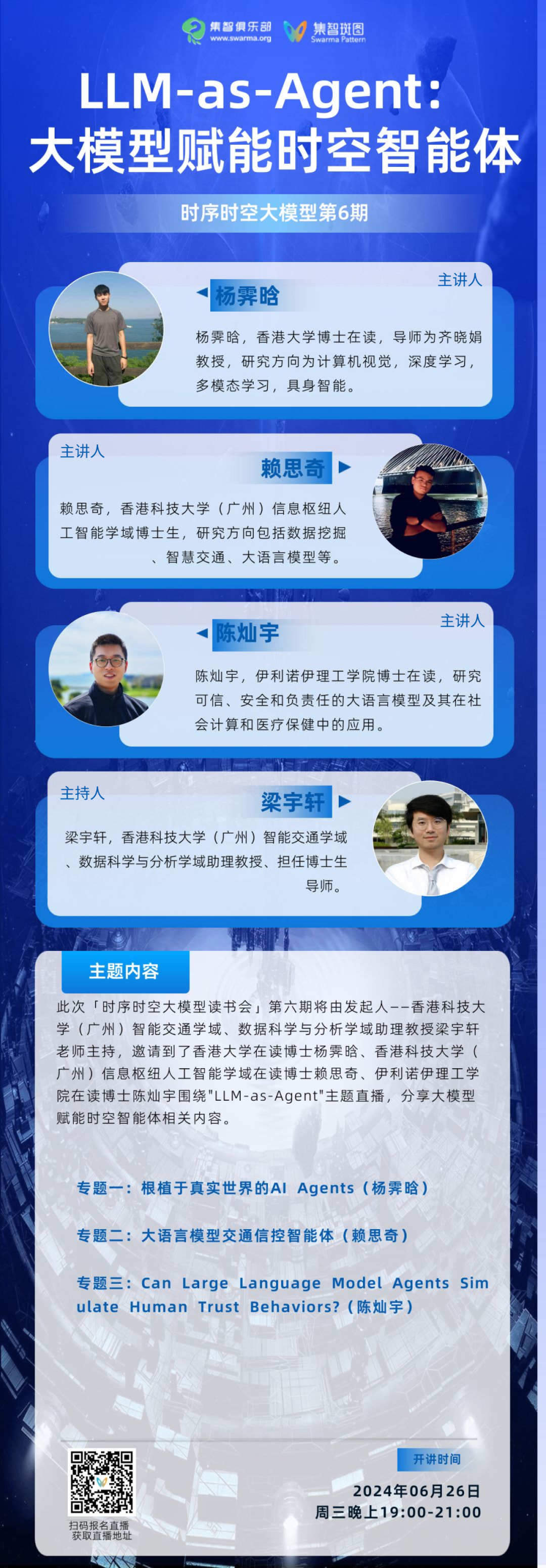

本期读书会作为「时序时空大模型读书会」系列读书会的第六期直播分享,邀请到了香港大学在读博士杨霁晗、香港科技大学(广州)信息枢纽人工智能学域在读博士赖思奇、伊利诺伊理工学院在读博士陈灿宇围绕 “LLM-as-Agent:大模型赋能时空智能体” 主题分享,主要从“根植于真实世界的AI Agents”、”大语言模型交通信控智能体”和“Can Large Language Model Agents Simulate Human Trust Behaviors?”三个专题展开。

分享内容大纲

分享内容大纲

专题一:根植于真实世界的AI Agents(杨霁晗)

-

AI Agents在真实世界中的应用研究进展

-

全球真实城市中的8个示例AI Agents

-

将真实世界融入虚拟环境的AI Agent平台

专题二:大语言模型交通信控智能体(赖思奇)

-

智能信号灯控制背景介绍

-

大语言模型交通信控智能体——LLMLight

-

实验性能对比及模型可解释性分析

-

总结及未来展望

专题三:Can Large Language Model Agents Simulate Human Trust Behaviors?(陈灿宇)

-

Motivation and background -

Do LLM Agents Manifest Trust Behavior? -

Does Agent Trust Align with Human Trust? -

Probing Intrinsic Properties of Agent Trust

核心概念

核心概念

-

大语言模型 Large Language Model; -

基座模型 Foundation Model; -

时空智能体 Spatio-temporal Agent; -

信号灯控制 Traffic Light Control; -

具身智能 Embodied AI; -

开放式具身智能体 Open-Ended Embodied Agent; -

人类模拟 Human Simulation; -

行为对齐 Behavioral Alignment; -

信任博弈 Trust Games;

分享人介绍

分享人介绍

(1)主讲人:杨霁晗

(2)主讲人:赖思奇

(3)主讲人:陈灿宇

陈灿宇,伊利诺伊理工学院博士三年级,研究方向是可信、安全和负责任的大语言模型及其在社会计算和医疗保健中的应用。目前重点关注大模型虚假信息的相关问题(“LLMs Meet Misinformation”:https://llm-misinformation.github.io/)。在ICLR、EACL、WWW、NeurIPS和AI Magazine等顶级会议和期刊上发表过论文,研究曾被The Register、Marktechpost AI Research News等媒体报道。获得了多项奖项,包括Sigma Xi Student Research Award 2024(2024年全校唯一获奖者),Didactic Paper Award (1/35 of all accepted papers) in the workshop ICBINB@NeurIPS 2023,Spotlight Research Award in the symposium AGI Leap Summit 2024。(个人主页:https://canyuchen.com)

(4)主持人:梁宇轩

梁宇轩,香港科技大学(广州)智能交通学域、数据科学与分析学域助理教授、博士生导师。长期从事人工智能与时空数据挖掘技术在城市计算、智能交通等领域的跨学科交叉研究。在TPAMI、TKDE、AI Journal、KDD、WWW、NeurIPS、ICML等多个权威国际期刊和会议发表高水平论文80余篇,其中CCF A类论文达60余篇。谷歌学术引用量3900余次,h-index为31,多篇论文入选最具影响力KDD/IJCAI论文。长期担任TKDE、TMC、VLDBJ等国际知名期刊审稿人,KDD、WWW、NeurIPS、ICML、ICLR等国际顶级会议程序委员会成员,曾获评SIGSPATIAL杰出程序委员会成员。多次担任数据挖掘和人工智能顶会 (KDD、IJCAI等) Workshop on Urban Computing, Workshop on AI for Time Series的联合主席。曾获得新加坡数据科学联合会论文研究奖,第二十三届中国专利优秀奖等海内外奖项。

本期主要参考文献

本期主要参考文献

1. V.-I.R.L.. Grounding Virtual Intelligence in Real Life. https://arxiv.org/abs/2402.03310

2. SayCan. Grounding Language in Robotic Affordances. https://arxiv.org/abs/2204.01691

3. Guanzhi Wang, Yuqi Xie, Yunfan Jiang, et al. Voyager: An Open-Ended Embodied Agent with Large Language Models. arXiv:2305.16291, 2023

4. J. Park, Joseph C. O’Brien, Carrie J. Cai, et al. Generative Agents: Interactive Simulacra of Human Behavior. ACM Symposium on User Interface Software and Technology, 2023

5. Siqi Lai, Zhao Xu, Weijia Zhang, et al. LLMLight: Large Language Models as Traffic Signal Control Agents. arXiv:2312.16044, 2024

6. Weijia Zhang, Jindong Han, Zhao Xu, et al. Towards Urban General Intelligence: A Review and Outlook of Urban Foundation Models. arXiv:2402.01749, 2024

7. Wei, Hua, et al. Colight: Learning network-level cooperation for traffic signal control. Proceedings of the 28th ACM International Conference on Information and Knowledge Management, 2019

8. Liang Zhang, Qiang Wu, Jun Shen, et al. Expression Might be Enough: Representing Pressure and Demand for Reinforcement Learning Based Traffic Signal Control. https://arxiv.org/abs/2112.10107

9. Peiyi Wang, Lei Li, Liang Chen, et al. Making Large Language Models Better Reasoners with Alignment. https://arxiv.org/abs/2309.02144

10. R.R.H.F.. Rank Responses to Align Language Models with Human Feedback without tears. https://arxiv.org/abs/2304.05302

11. Chengxing Xie, Canyu Chen, Feiran Jia, et al. Can Large Language Model Agents Simulate Human Trust Behaviors? https://arxiv.org/abs/2402.04559

12. Gati Aher, Rosa I. Arriaga, Adam Tauman Kalai. Using Large Language Models to Simulate Multiple Humans and Replicate Human Subject Studies ICML. https://arxiv.org/abs/2208.10264

读书会阅读材料较多,为了更好地阅读体验,可扫描下方二维码进入集智斑图页面,阅读并收藏感兴趣的论文。

直播信息

直播信息

时间:

参与方式:

1、集智俱乐部 B 站免费直播,扫码可预约。

2、本期读书会公开进行,扫码即可直接获取读书会回看权限。欢迎感兴趣的朋友报名新一季时序时空大模型读书会,加入群聊,获取系列读书会回看权限,成为“Time-LLMs”社区的种子用户,与社区的一线科研工作者与企业实践者沟通交流,共同推动社区的发展。

报名成为主讲人:

时序时空大模型读书会招募中

点击“阅读原文”,报名读书会