从命令到协同:人类如何成为AI最强训练搭档?

摘要

在传统的机器学习范式中,人类往往只是训练数据的提供者,或是模型决策的被动接受者。但近年来,一种新的协作式智能浪潮正在兴起。在2022年发表于 Artificial Intelligence Review 上的一篇综述,系统梳理了这一转变路径:AI正从“自动执行命令”的封闭系统,走向“与人协同共学”的开放架构。在这篇前沿综述中,研究者将人类重新引入模型训练的核心环节,从主动学习、交互式学习,到机器教学与课程设计,重构人机智能协同的新秩序。

本周六下午伍海燕老师将进行「大模型时代下的人机协同与交互」读书会的第一次分享,探讨人工智能如何通过复杂社会行为建模、高生态效度实验任务构建及人机互动理解,重塑社会决策研究框架,介绍“启策认知(CogniAND)”平台,推动传统实验范式向融合多主体交互与认知机制的转型,助力AI提升社会理解与适应能力。

关键词:人在环路、主动学习、交互式机器学习、机器教学、课程学习、可解释 AI

赵思怡丨作者

周莉丨审校

论文题目:Human-in-the-loop machine learning: a state of the art

发表时间:2022年8月17日

论文地址:https://link.springer.com/article/10.1007/s10462-022-10246-w

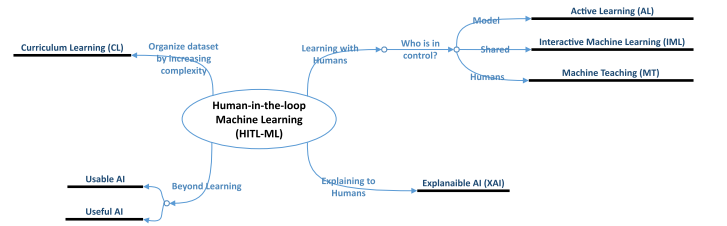

发表期刊:Artificial Intelligence Review

研究人员正在探索一种称为“人在环路”机器学习的新领域,旨在定义人类与机器学习算法之间多样化的协作方式。根据控制权的不同,主要形式包括:由系统主导的主动学习、用户与模型紧密互动的交互式机器学习,以及由人类专家引导模型学习的机器教学。此外,人类还可通过课程学习为模型提供结构化样例以提升学习效率,或借助可解释AI理解模型的决策逻辑。这种人机协作不仅限于训练过程,还延伸至“可用且有用的人工智能”(Usable and Useful AI)等新概念,强调技术在实际应用中的易用性与实用性。本文旨在梳理相关概念,澄清术语歧义,明确方法边界,并揭示各类技术之间的内在联系与相互影响,系统呈现该领域的研究现状与发展脉络。

人机协同机器学习:让AI更懂人类需求

人机协同机器学习:让AI更懂人类需求

近年来,人工智能(AI)在医疗诊断、金融风控、自动驾驶等关键领域加速落地,但传统机器学习(ML)模型仍面临诸多瓶颈。一方面,其高度依赖大量标注数据,训练成本高昂;另一方面,“黑箱”特性导致决策过程难以解释,缺乏透明性和可控性,严重制约了可信度与社会接受度。随着应用场景的拓展,这种封闭式训练模式暴露出越来越多问题:适应性差、更新滞后、依赖人工标注等。为破解这一困境,研究者提出了人在环路机器学习(Human-in-the-loop Machine Learning, HITL-ML)的理念,强调在模型训练与优化中建立更紧密的人机协作机制,使人类从被动的数据提供者转变为积极的参与者。

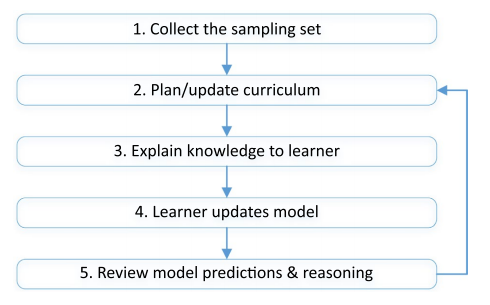

图1:人在环路机器学习(HITL-ML)思维导图

根据人类在学习流程中扮演的不同角色,HITL-ML衍生出了多种路径,包括主动学习(Active Learning, AL)、交互式机器学习(Interactive Machine Learning, IML)、机器教学(Machine Teaching, MT)、课程学习(Curriculum Learning, CL)及可解释AI(Explainable AI, XAI)等。这些方法共同推动着机器学习从传统的“离线训练、静态部署”的封闭模式,向更加灵活的“动态交互、持续进化”的开放范式转变。这种转变不仅提高了模型的性能和适应性,还增强了系统的透明度和用户的信任感,预示着未来AI技术发展的新方向。

主动学习(AL):让系统学会“提问”

主动学习(AL):让系统学会“提问”

在传统机器学习中,模型被动接受标注数据,而AL赋予算法“提问权”——系统主动选择对提升性能最关键的未标注样本,交由人类专家标注。这一过程的核心在于设计查询策略,例如基于不确定性采样优先选择模型预测模糊的数据,或通过多样性采样覆盖数据分布的盲区。AL的典型应用场景包括医学影像标注和自然语言处理(NLP)。例如,在癌症病理报告分类中,AL可减少80%的标注工作量,同时保持高准确率。然而,AL的局限性在于假设人类标注者始终可靠,且忽略交互中的认知负荷。若系统频繁请求标注琐碎样本,可能导致用户疲劳,甚至降低标注质量。

交互式机器学习(IML):动态协作的新模式

交互式机器学习(IML):动态协作的新模式

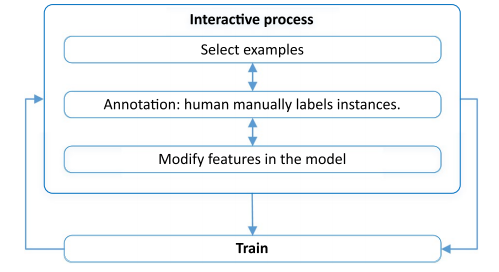

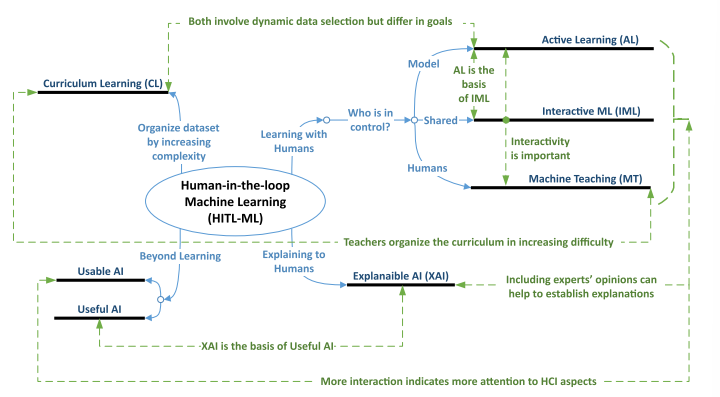

如果说AL是“系统主导”,IML则强调人机的双向互动。用户不仅作为标注者,还能通过可视化界面实时调整模型参数、修正错误预测,甚至参与特征工程。例如,音乐生成工具Wekinator允许音乐家通过手势实时训练模型,即时调整生成旋律的风格。IML的成功关键在于用户体验(UX)设计。以生态学研究工具AIDE为例,用户通过拖拽标注图像中的动物行为,模型即时更新并反馈检测结果,形成“标注-训练-验证”的闭环。这种动态交互尤其适合处理非结构化数据(如视频、传感器信号),但其挑战在于平衡算法效率与用户认知负担,避免陷入“过度调试”的困境。

图2:交互式机器学习(IML)学习过程的示意图

机器教学(MT):专家知识的定向传递

机器教学(MT):专家知识的定向传递

MT将人类教师置于核心地位,强调通过结构化课程设计引导模型学习。与AL和IML不同,MT的教师需预先规划教学顺序,例如从简单病例到复杂病症的渐进教学,模拟人类教育中的“循序渐进”原则。

图3:机器教学(MT)过程的示意图

微软团队开发的PICL系统是MT的典型代表。医生通过标注关键医学特征(如肿瘤边缘),并解释诊断逻辑,帮助模型建立可解释的决策路径。MT的优势在于降低对标注数据量的依赖,但其难点在于如何将专家经验转化为机器可理解的课程逻辑。近年来,迭代机器教学(Iterative Machine Teaching)通过强化学习自动优化教学顺序,成为突破方向。

课程学习(CL):模仿人类的学习路径

课程学习(CL):模仿人类的学习路径

CL受人类教育启发,主张按难度递增的顺序训练模型。例如,在图像识别中,先让模型学习清晰图像,再逐步加入噪声或遮挡样本。研究表明,合理的课程设计可加速模型收敛,提升鲁棒性。CL的核心挑战在于量化样本“难度”。传统方法依赖人工定义(如句子长度、图像复杂度),而自步学习(Self-Paced Learning, SPL)等自动化技术通过模型损失动态调整训练集,实现“越学越难”的自适应过程。在神经机器翻译(NMT)中,CL可将训练效率提高30%,同时减少对噪声数据的敏感度。

可解释AI(XAI):打破黑箱的信任基石

可解释AI(XAI):打破黑箱的信任基石

当AI应用于医疗诊断等高风险场景时,模型的可解释性至关重要。XAI通过可视化、特征归因等技术揭示模型决策逻辑。例如,在卷积神经网络(CNN)中,Grad-CAM可高亮影响分类的关键图像区域;在循环神经网络(RNN)中,注意力机制能展示文本分类的依据词汇。XAI的终极目标是建立用户信任。研究显示,医生更倾向于采纳能提供病例对比和决策链解释的AI辅助系统。然而,当前多数XAI工具仍面向技术人员,如何为非专家设计直观的可视化界面,仍是亟待解决的难题。

从“可用”到“有用”:AI与社会的深度协同

从“可用”到“有用”:AI与社会的深度协同

超越技术层面,人机协同理念正推动AI向“可用和有用AI”(Usable and Useful AI)进化。前者关注用户体验,例如通过交互设计降低标注门槛;后者强调社会价值,确保AI符合伦理规范并满足真实需求。例如,在慢性病管理中,AI系统可结合患者日常数据(如运动量、血糖值)生成个性化建议,并通过对话式交互(如聊天机器人)解释推荐理由,形成“监测-决策-反馈”的良性循环。这种以人为中心的设计,正是第三波AI浪潮的核心方向。

未来展望:人机共生下的智能新范式

未来展望:人机共生下的智能新范式

人在环路机器学习并非单一技术的堆砌,而是涵盖算法、交互、伦理的复杂体系。当前趋势显示:

-

交互增强:从被动标注到实时协作,AR/VR技术将进一步提升人机交互的自然性。

-

自动化工具:AutoML与MLOps平台正在降低HITL-ML的开发门槛,使领域专家能直接参与模型迭代。

-

可信AI:通过XAI与伦理审查的结合,构建“透明且负责任”的智能系统。

图4:HITL-ML及其相关关系的思维导图

未来,随着脑机接口、联邦学习等技术的成熟,人机协同模式或将从“人类指导机器”发展为“双向认知协同”,真正实现人工智能与人类社会的共生共荣。

-直播预告-

「大模型时代下的人机交互与协同」

读书会

在智能时代,虽然机器学习和深度学习算法在自然语言处理、计算机视觉和语音识别等领域取得了显著进展,但这些技术依赖大量标注数据,并在面对复杂动态环境时表现出决策能力的局限,特别是在需要直觉、创造力和道德判断的任务上远逊于人类。相比之下,人类智能能够基于背景信息在不完全条件下高效决策,适应变化与不确定性,并作出伦理情感驱动的判断。因此,单纯依靠机器智能难以满足复杂任务需求,人机协同成为必要选择,通过两者紧密合作,既能利用机器的运算速度和处理能力,又能借助人类智慧和创造力,实现更高效智能的决策与创新。

在此背景下,集智俱乐部联合中国科学技术大学教授赵云波、华东师范大学副教授吴兴蛟两位老师共同发起「大模型时代下的人机交互与协同」读书会。本次读书会将探讨:人类智能和机器智能各自的优势有哪些?智能边界如何?如何通过更有效的标注策略和数据生成技术来解决数据稀缺问题?如何设计更加高效的人机协作系统,实现高效共赢的效果?如何提高机器决策的可解释性与透明性,确保系统的可信度?如何通过多模态协作融合不同感知通道,应对复杂的决策任务? 读书会从7月5日开始,预计持续约8周。诚挚邀请领域内研究者、寻求跨领域融合的研究者加入,共同探讨。

详情请见:人类与机器的智慧碰撞:人机协同的智能时代读书会启动

6. 探索者计划 | 集智俱乐部2025内容团队招募(全职&兼职)