神经形态计算的物理学

摘要

神经形态计算(neuromorphic computing)从脑科学汲取灵感来为信息处理创造节能硬件,并能适应高度复杂的任务。2020年发表在 Nature Reviews Physics 上的一篇文章给出了重新发明电子元件来设计神经形态计算硬件的必要性。研究表明,物理和材料科学研究是创造人工纳米神经元和突触,将它们大规模联系起来,在复杂系统中组织它们,并用它们进行高性能运算的关键。作者们描述了两种研究人员汲取灵感的途径,一种是从人工智能中汲取灵感,另一种是从神经科学中汲取灵感,文章强调了最近这两种途径获得的惊人成就。最后讨论了神经形态计算物理学的挑战和前景,包括算法和硬件的联合开发,在小型玩具系统中取得的重大进展以及大尺度网络的构建。

研究领域:神经形态计算,神经网络,神经科学

张晓雨 | 作者

邓一雪 | 编辑

论文题目:

Physics for neuromorphic computing

论文链接:

https://www.nature.com/articles/s42254-020-0208-2

1. 为什么我们要从大脑中汲取灵感?

1. 为什么我们要从大脑中汲取灵感?

生物的大脑能执行极其复杂的任务,而且计算的能源预算非常低。相对地,虽然目前的数字计算机为高精度的计算进行了优化,但是当它们运行认知类型的任务时,会消耗大量能量。

无论是在算法还是在物理实现层面,大脑与人类制造的计算系统都有很大不同。算法层面,包含1011个神经元和1015个突触连接的人脑,是一个具有动态性和可重构性的复杂系统,可以从经验中学习。物理硬件层面,大脑的特点则是基于生物实体、利用细胞的随机性在非常低的能量状态下运作、同时使用二进制(单个尖峰)和模拟(体细胞动力学、突触权重)编码、使用集体行为来计算,这些方面数字电子产品都表现出局限性。

2. 为什么物理学和材料学

对神经形态计算至关重要?

2. 为什么物理学和材料学

对神经形态计算至关重要?

在大脑中,神经元大致上可以被视为处理器,在突触的支持下可以直接访问存储器。相反,目前的电子技术在本质上讲,内存的计算分类成不同的物理单元,数据必须在它们之间来回传输,这个过程减慢了计算速度,大大增加了学习和推理的能量消耗。这种“冯·诺伊曼瓶颈”是人工智能算法的一个问题。

因此,神经形态计算的一般范式是从大脑的拓扑结构中获得灵感,建立由物理神经元组成的电路,这些神经元通过物理突触相互连接,并以非易失性的方式在原地实现存储,从而大大减少了在电路中传输数据的需求,并在速度和能源效率方面取得巨大收益。但是要建立由几百万个神经元和突触组成的低功耗芯片,仅使用互补金属氧化物半导体(CMOS)技术会让系统会变得很笨重,并且很难实现神经元之间的高度互联。

3. 大脑的这些一般特征如何转化为

对神经形态计算领域的重要贡献?

3. 大脑的这些一般特征如何转化为

对神经形态计算领域的重要贡献?

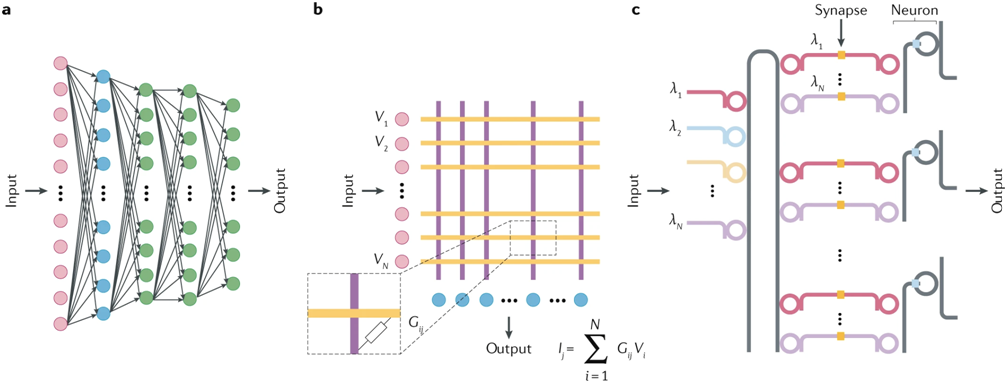

由于还没有大脑如何工作的精确模型,目前正在开发两类主要方法。第一类方法是将目前在人工智能中使用的传统神经网络算法映射到专用物理系统,以提高其实施的能源效率。当今最能解决实际应用的神经网络是深度网络,到目前为止,已经提出了两种可能的可扩展架构,用于使用物理在芯片上映射深度网络:混合 CMOS/忆阻系统(图1b)和光子系统(图1c)。在混合 CMOS/忆阻系统中,神经元由模拟或数字 CMOS 组成,流经网络的信息是电流。因此,为了调节信息流,突触应该充当电流的阀门。这种阀可以用忆阻器(“记忆电阻器”的缩写,也称为电阻开关器件)来实现。另一种可扩展到深度网络的神经形态计算方法是基于光子神经网络。这些网络可以仅由光学组件制成,也可以使用光电设备将光学与电子设备混合。实现神经元所需的非线性可以由克尔效应或半导体激光器中的载流子加热提供。

第二类方法是超越此类算法,从神经科学中汲取灵感,为人工神经网络配备额外的特征和动力学,以期实现更复杂的计算。因为信息可以以神经元的速率和它们之间的时间进行编码,所以重要的神经形态硬件研究专注于实现尖峰神经网络。但是大脑比当今的人工智能算法复杂得多,生物神经元不能被简化为它们的输入和输出之间的非线性函数。为了实现其他的突触和神经元特性,不同的仿生方法被研发出来进行电路设计,从而在大规模系统内进行协同集成,并实现学习算法。

图1:为深度神经网络开发的硬件。(a)深度神经网络由突触(箭头)连接的多层神经元(圆圈)组成。(b)忆阻交叉阵列连接两层神经元。插图表示单个忆阻器单元,垂直地连接一行和一列。突触前CMOS神经元(红色)对每行施加电压。每列的输出电流 Ij 是所有输入电压 Vi 由忆阻器电导 Gij 加权后的总和。每一列的放大器驱动突触后CMOS神经元(蓝色)。(c)由圆形谐振器组成的光神经网络,将不同波长 λi 的输入(不同颜色)耦合到一个神经元(灰色)。突触(橙色方块)和神经激活函数(绿色方块)由相变材料实现。

4. 算法和物理计算基板应该齐头并进

4. 算法和物理计算基板应该齐头并进

设备层面存在两个主要挑战,即实现具有学习能力的神经形态系统。第一是精度,第二是在施加电压或电流的情况下执行与重量无关的重量变化。算法层面,首先要改进算法以便它们能够在物理硬件存在缺陷和不可靠性的情况下工作。再者因为大脑能够通过不可靠和随机的成分进行学习,应该有可能发明新的算法,允许使用不完美、动态和嘈杂的基本纳米设备进行学习,人们甚至可以想象利用纳米器件缺陷或动态进行信息处理的算法。开发小型物理神经形态系统来检验一些假设并得出了一些结论。作者通过描述自己的工作来说明这种方法,重点是开发由自旋电子纳米振荡器作为神经元组成的实验性玩具神经网络。

神经形态计算开发的最终目标是构建包含数百万个组件的大规模系统。因此,应注意研究可扩展的材料和物理。第一个挑战是,到目前为止,大多数神经形态研究小组都专注于开发大规模忆阻器阵列以用作突触或生物学上合理的神经元设备。密集且有效地互连纳米突触和纳米神经元是神经形态计算的一大难点。一个策略是利用物理学、材料科学和纳米技术在系统层面将神经网络密集连接,并达到每个神经元超过 1000 个突触的密度,接近大脑互连水平。在这个方向上的一个开创性想法是 3D 交叉网 (3D crossnets),其中忆阻器交叉开关阵列相互堆叠。用物理学实现大规模神经形态系统的第二个挑战是处理纳米器件的可变性。在片上训练网络是补偿这些设备变化的最佳方式。

在这篇文章中,作者强调了物理学与神经形态计算的相关性。神经形态计算是一个快速发展的领域,目前在其中测试了许多方法,并且都有其优点和缺点。未来神经网络硬件将使用哪些材料和物理原理的问题仍然是开放式的。

论文 Abstract

神经动力学模型读书会

随着电生理学、网络建模、机器学习、统计物理、类脑计算等多种技术方法的发展,我们对大脑神经元相互作用机理与连接机制,对意识、语言、情绪、记忆、社交等功能的认识逐渐深入,大脑复杂系统的谜底正在被揭开。为了促进神经科学、系统科学、计算机科学等领域研究者的交流合作,我们发起了【神经动力学模型读书会】。

集智俱乐部读书会是面向广大科研工作者的系列论文研读活动,其目的是共同深入学习探讨某个科学议题,激发科研灵感,促进科研合作。【神经动力学模型读书会】由集智俱乐部和天桥脑科学研究院联合发起,将于3月19日开始,每周六下午14:00-16:00(或每周五晚上19:00-21:00,根据实际情况调整)进行,预计持续10-12周。期间将围绕神经网络多尺度建模及其在脑疾病、脑认知方面的应用进行研讨。

详情请见:

推荐阅读

-

Nature通讯:判别神经网络间的个体差异——计算神经科学新工具 -

网络神经科学前沿:大脑如何在局部和全局高效处理信息? -

作为因果科学家的神经系统:因果编码 -

《张江·复杂科学前沿27讲》完整上线! -

成为集智VIP,解锁全站课程/读书会 -

加入集智,一起复杂!

点击“阅读原文”,报名读书会