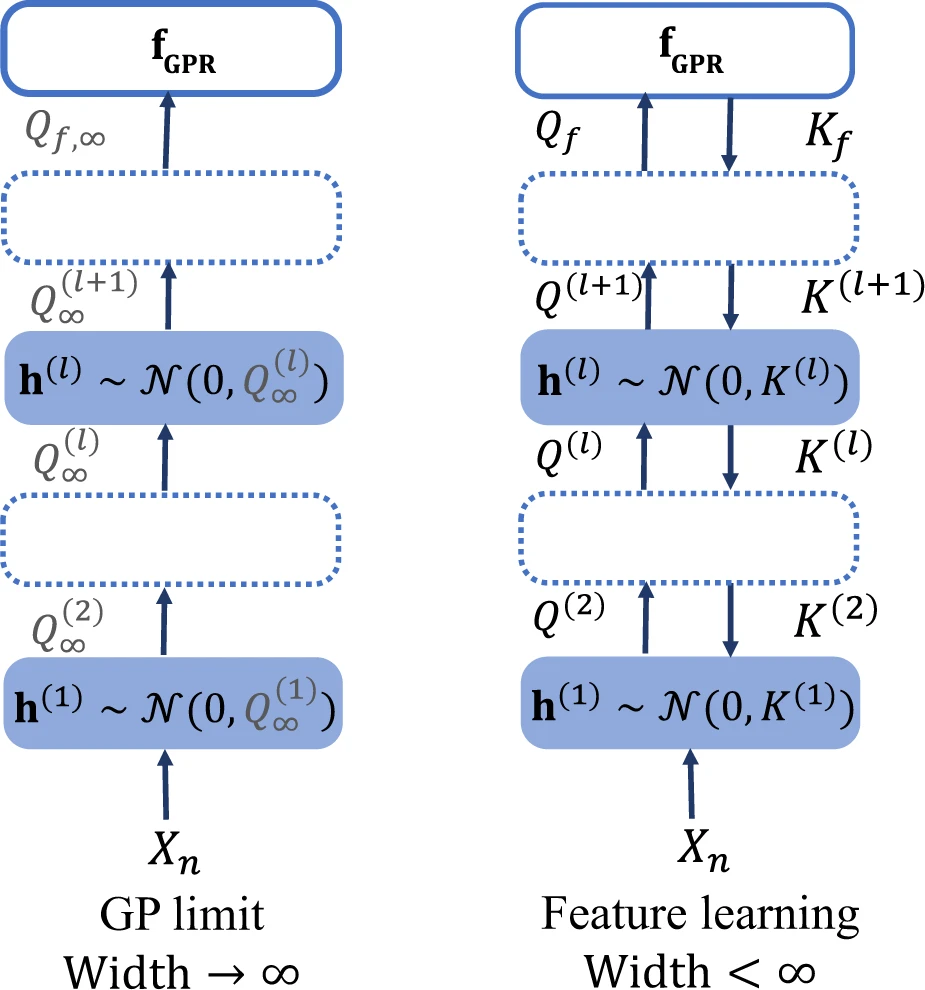

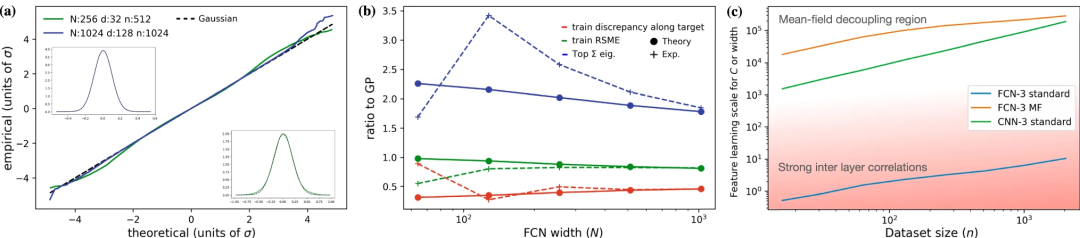

Nat. Commun. 速递:CNN 中的尺度分离与特征学习的热力学描述

关键词:深度学习,快慢变量,尺度分离,热力学

论文题目:Separation of scales and a thermodynamic description of feature learning in some CNNs 论文来源:Nature Communications 论文链接:https://www.nature.com/articles/s41467-023-36361-y

复杂科学最新论文

推荐阅读

-

前沿综述:面向深度学习的集体智能 -

Nat. Mach. Intell. 速递:几何深度学习揭示微观运动的时空特征 -

PNAS速递:基于相似加权交叉学习的深度神经网络和大脑学习 -

《张江·复杂科学前沿27讲》完整上线! -

成为集智VIP,解锁全站课程/读书会 -

加入集智,一起复杂!