Nat. Mach. Intell. 速递:空间嵌入式循环神经网络揭示结构和神经功能发现之间的广泛联系

关键词:类脑计算,空间嵌入,小世界网络,模块化

论文题目:Spatially embedded recurrent neural networks reveal widespread links between structural and functional neuroscience findings 论文期刊:Nature Machine Intelligence 斑图地址:https://pattern.swarma.org/paper/8f0edd32-87f8-11ee-bc79-0242ac17000e 论文地址:https://www.nature.com/articles/s42256-023-00748-9

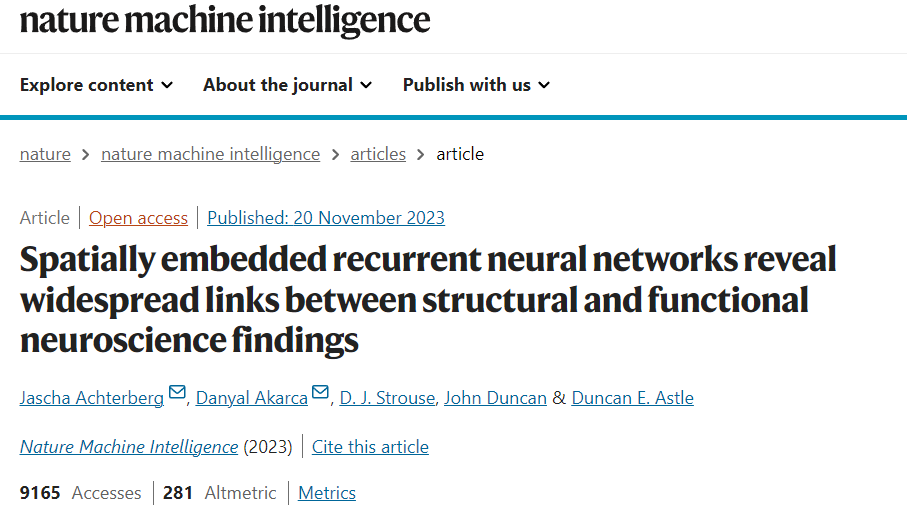

图1:a)在人工神经网络训练过程中,通过加入正则化项,使模型训练后变的稀疏,模块化。b)每个神经元处在一个设定的三维坐标上,高斯距离更长的神经元连接具备更长的惩罚项。c)将 RNNs 嵌入拓扑空间,引导剪枝过程实现高效的网络内交流,d)加入正则项后,网络会激励短连接的产生,不利于长连接的产生。e)对比加入和不加入空间正则化机制的网络。f)网络要解决的一步推理任务,从二十步开始,目标出现在网格上的四个位置之一:上/下、左/右(浅蓝色表示)。随后是十步延迟,在此期间必须记住目标位置。然后在 20 个步骤中提供两个选择选项。利用先前的目标信息,代理必须选择离目标更近的选项。

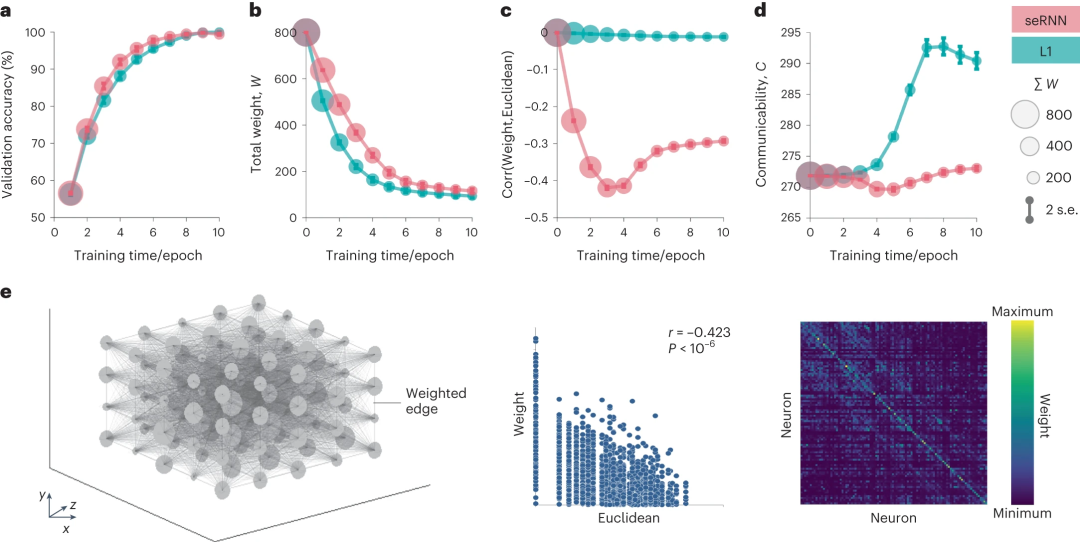

图2:经过L1正则化与seRNN经过训练的预测精度相当,L1的总权重更低,空间在训练3轮后下降到最低,其模块化程度在训练6轮后显著提高,seRNN训练好的网络结构如e所示

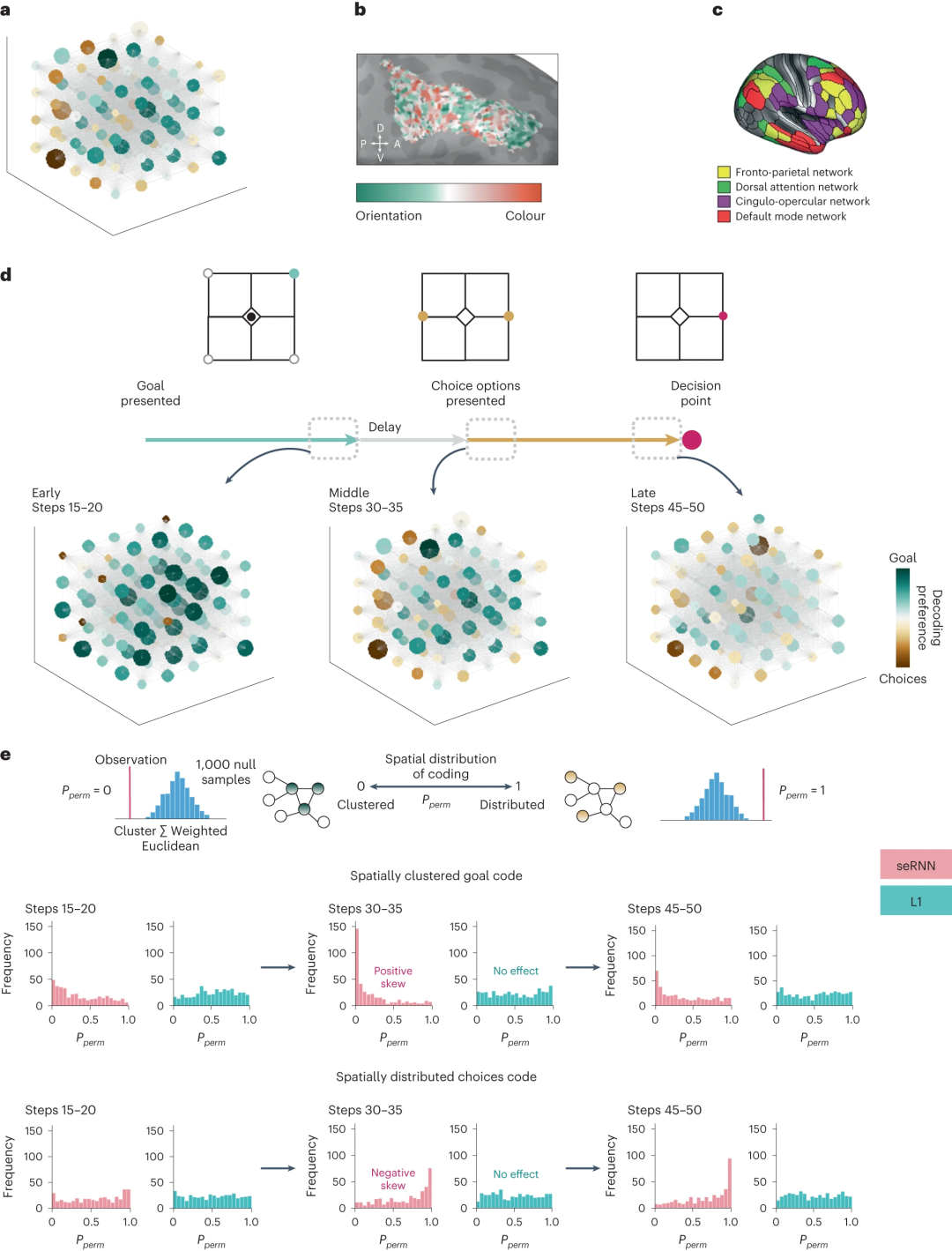

图3:训练后的seRNN具有和脑类似的功能分区,一部分用以识别颜色,一部分用以识别方位,对于据对策和目标的存储,也存在对应的神经元中

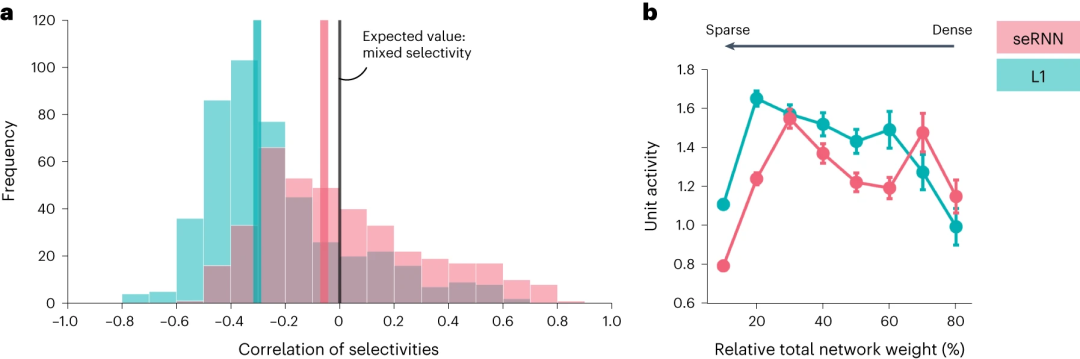

图4:训练完成的seRNN相比基线情况,做决策时激活的神经元更少,因此能耗更低

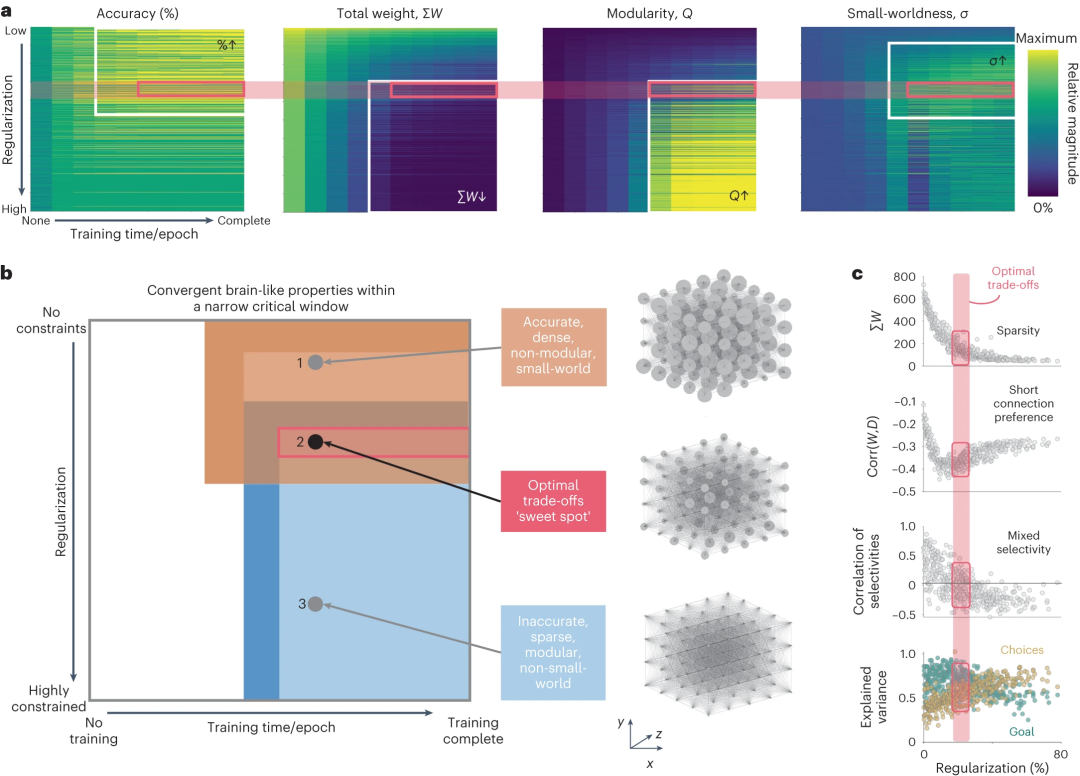

图5:在100次seRNN的训练过程中,训练结果处在即足够准确,又具备模块化和小世界网络性质的最优权衡处

NeuroAI读书会

详情请见:

NeuroAI 读书会启动:探索神经科学与人工智能的前沿交叉领域

推荐阅读