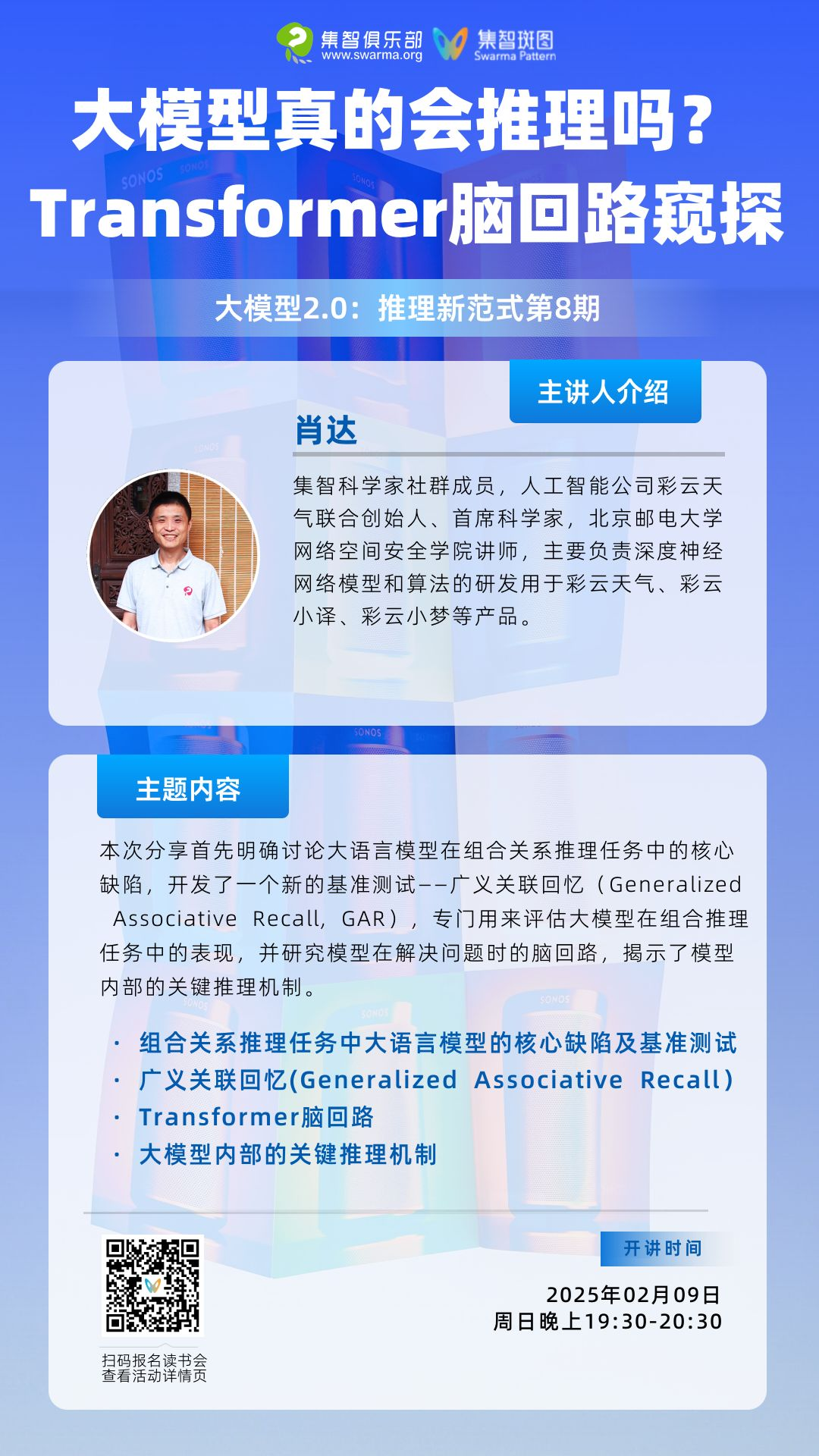

大模型真的会推理吗?Transformer脑回路窥探丨周日直播·大模型2.0读书会

导语

分享内容简介

分享内容简介

大纲

大纲

-

组合关系推理任务中大语言模型的核心缺陷

-

组合关系推理任务中大模型的基准测试

-

广义关联回忆(Generalized Associative Recall, GAR)

-

Transformer脑回路

-

大模型内部的关键推理机制

主讲人介绍

主讲人介绍

肖达,集智科学家社群成员,人工智能公司彩云天气联合创始人、首席科学家,北京邮电大学网络空间安全学院讲师,主要负责深度神经网络模型和算法的研发用于彩云天气、彩云小译、彩云小梦等产品。

主要涉及到的参考文献

主要涉及到的参考文献

-

Ni R, Xiao D, Meng Q, et al. Benchmarking and Understanding Compositional Relational Reasoning of LLMs[J]. arXiv preprint arXiv:2412.12841, 2024.

直播信息

直播信息

直播时间:

2025年2月9日(本周日)晚上19:30-20:30

参与方式:

扫码报名

大模型2.0读书会启动

o1模型代表大语言模型融合学习与推理的新范式。集智俱乐部联合北京师范大学系统科学学院教授张江、Google DeepMind研究科学家冯熙栋、阿里巴巴强化学习研究员王维埙和中科院信工所张杰共同发起「大模型II:融合学习与推理的大模型新范式 」读书会,本次读书会将关注大模型推理范式的演进、基于搜索与蒙特卡洛树的推理优化、基于强化学习的大模型优化、思维链方法与内化机制、自我改进与推理验证。希望通过读书会探索o1具体实现的技术路径,帮助我们更好的理解机器推理和人工智能的本质。

从2024年12月7日开始,预计每周六进行一次,持续时间预计 6-8 周左右。欢迎感兴趣的朋友报名参加,激发更多的思维火花!

详情请见:大模型2.0读书会:融合学习与推理的大模型新范式!